模型参数(Model Parameters)是人工智能模型(特别是深度学习模型)内部的可调节变量。

你可以把它们想象成模型的“记忆”或“知识权重”。在模型训练之前,这些参数是随机初始化的(模型什么都不懂);经过海量数据的训练后,这些参数的数值被不断调整,最终固定下来,形成了模型对世界的理解能力。

1. 核心类比:调音台

想象一个拥有亿万个旋钮的超级调音台:

- 初始状态:所有旋钮都是随机乱放的,这时候播放音乐(输入数据),出来的声音是噪音(输出毫无逻辑)。

- 训练过程:工程师(训练算法)听着噪音,不断地微调每一个旋钮的位置。如果某个旋钮调大一点,声音就更清晰,那就保留这个变化;如果更糟,就调回来。

- 训练完成:经过无数次调整,所有旋钮都停在了最佳位置。这时候,无论输入什么音乐,调音台都能完美处理。

- 参数:这亿万个旋钮当前的具体数值,就是“模型参数”。

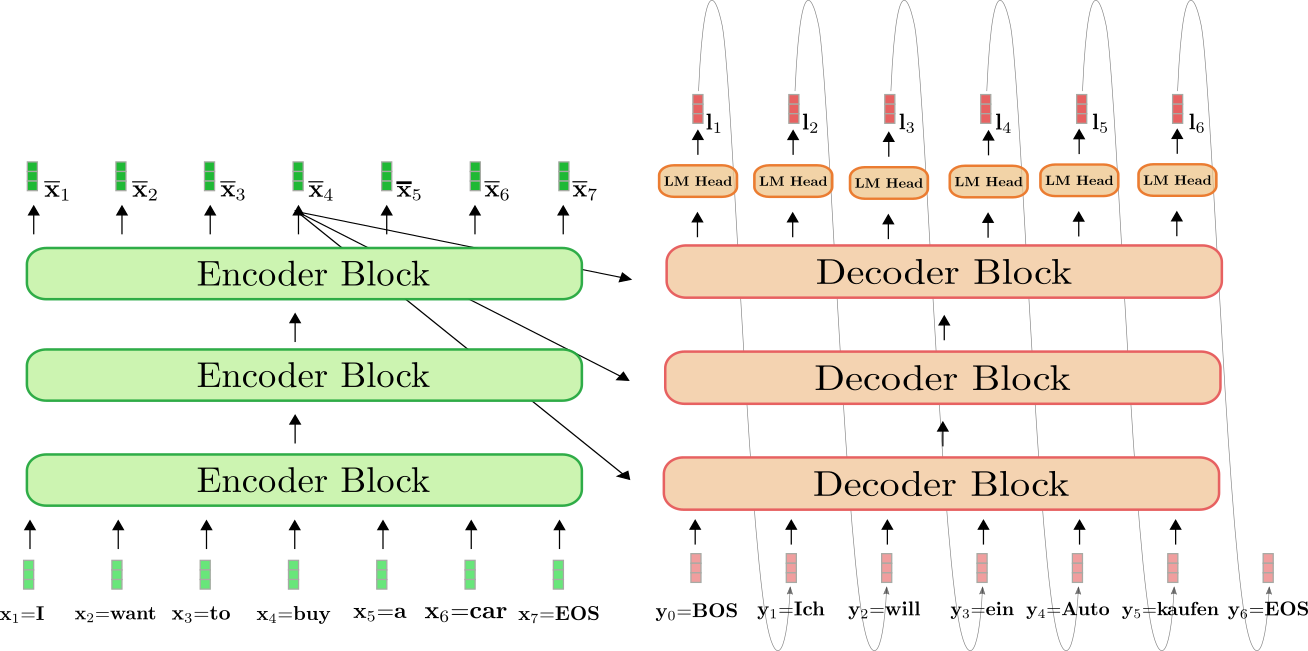

2. 参数具体存了什么?

在神经网络中,参数主要体现为权重(Weights)和偏置(Biases):

- 权重:决定了输入信号的重要性。比如看到“苹果”这个词,权重会告诉模型,它和“水果”、“红色”、“好吃”的联系很强,而和“汽车”的联系很弱。

- 偏置:相当于一个基础阈值,帮助模型更好地拟合数据。

关键点:参数本身不是具体的文字或图片,而是一堆浮点数(如 0.123. -5.67. 0.0001)。正是这些数字的组合,编码了语法、逻辑、事实知识甚至推理能力。

3. 参数量级意味着什么?(7B, 70B, 175B…)

你常听到的 7B (70亿)、70B (700亿)、1.8T (1.8万亿) 指的就是参数的数量。

- 小参数模型 (例如 < 10B):

- 特点:反应快,可以在普通电脑甚至手机上运行。

- 能力:擅长简单对话、文本分类、提取信息。但在复杂逻辑推理、写长代码或冷门知识上容易“胡说八道”。

- 比喻:像一个聪明的本科生,反应快,但知识面有限。

- 中等参数模型 (例如 30B – 70B):

- 特点:需要高性能显卡或多卡并行。

- 能力:在大多数任务上表现优异,能处理复杂的指令,逻辑推理能力强,是目前性价比最高的区间(如 Llama-3-70B, Qwen-72B)。

- 比喻:像一个经验丰富的硕士或专家,既聪明又有深度。

- 超大参数模型 (例如 > 100B,甚至万亿级):

- 特点:需要巨大的算力集群才能训练和运行,成本极高。

- 能力:具备极强的泛化能力,能处理极罕见的任务,涌现出惊人的推理和创造力,甚至表现出类似“直觉”的能力。

- 比喻:像一个博古通今的博士团队或图书馆,几乎无所不知,但运行缓慢且昂贵。

4. 参数 vs 其他概念的区别

- 参数 (Parameters):模型内部固定的知识(训练好后通常不变,除非微调)。这是模型“脑子”的大小。

- 上下文 (Context/Tokens):模型外部临时接收的信息(你刚才说的话)。这是模型“短期记忆”的长度。

- 例子:一个参数量很小的模型(脑子小),也可以有很长的上下文(短期记忆力好),能读完一本书,但它可能读不懂书里复杂的深层逻辑。

- 超参数 (Hyperparameters):在训练之前人为设定的规则(如学习率、层数),用来控制训练过程,它们不属于模型学到的知识。

5. 参数越多越好吗?

不一定。

- 边际效应递减:当参数达到一定规模(如70B以上),再增加参数带来的能力提升会变慢,而成本和延迟会指数级上升。

- 数据质量更重要:如果训练数据很烂,参数再多也是“垃圾进,垃圾出”(Garbage In, Garbage Out)。现在的趋势是用更高质量的数据训练中等规模的模型,往往能打败用烂数据训练的超大模型。

- 应用场景:如果你只是要在手机上做一个简单的翻译助手,一个3B的小模型比一个175B的巨模型更合适,因为它更快、更省电。

小编最后说下

模型参数就是模型“脑子”里的神经元连接强度。

- 数量越多,理论上模型越聪明、知识越广博。

- 但它们也代表了存储大小(下载模型需要多少GB显存/内存)和计算成本(跑起来有多慢、多贵)。

- 目前的行业趋势不再是盲目追求参数量,而是追求参数效率(如何用更少的参数实现更强的智能)。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...