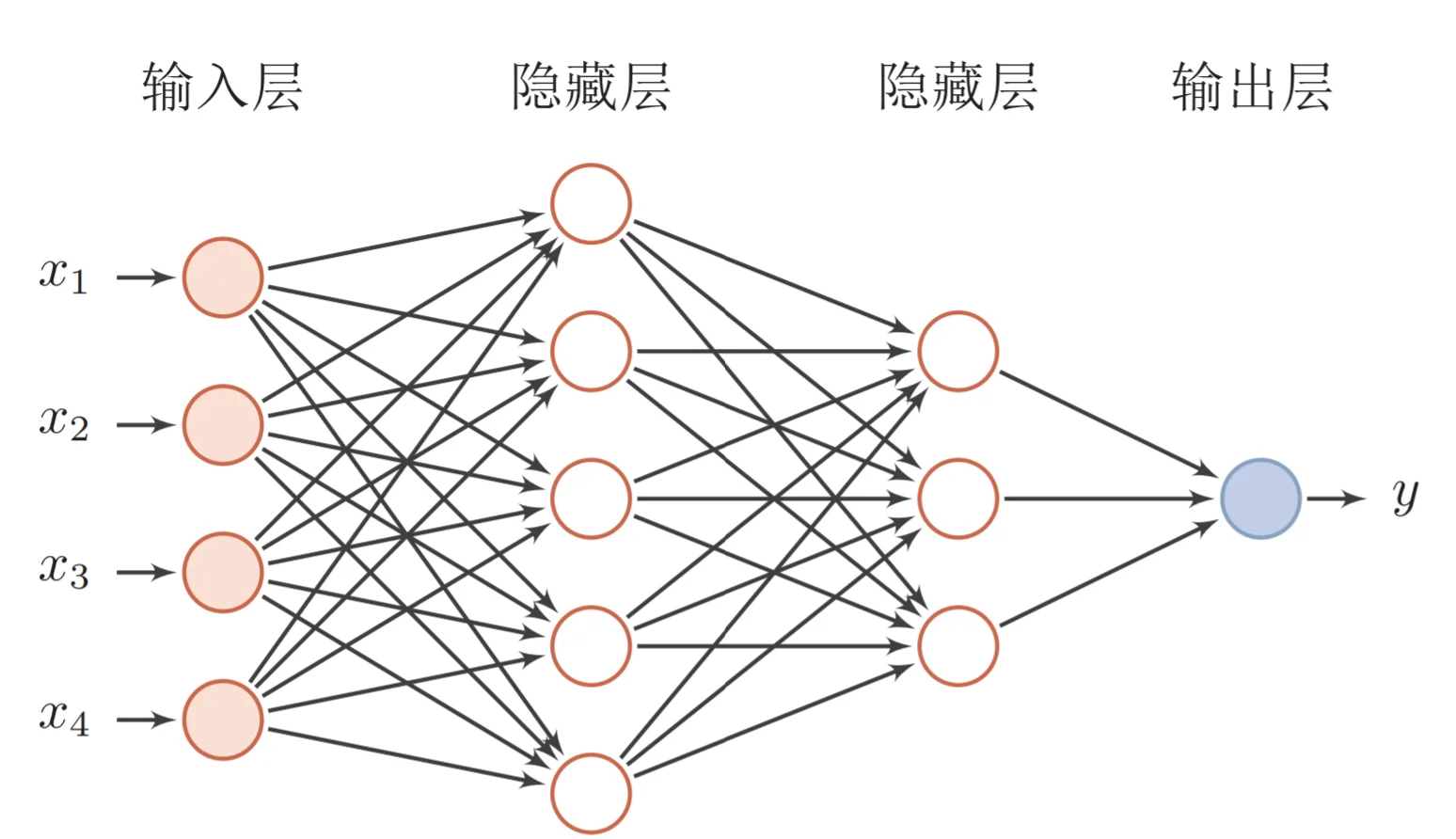

前馈神经网络(Feedforward Neural Network, FNN),也称为多层感知机(Multilayer Perceptron, MLP),是人工神经网络中最基础、最经典的结构。它的核心特征是信息单向流动:从输入层经过隐藏层,最终到达输出层,网络中不存在任何反馈回路或循环连接。

以下是关于前馈神经网络的详细原理解析:

1. 核心结构

前馈神经网络通常由三层类型的节点(神经元)组成:

- 输入层 (Input Layer):负责接收原始数据(如图像的像素值、文本的向量表示等)。这一层不进行计算,只是传递数据。

- 隐藏层 (Hidden Layer):位于输入层和输出层之间,可以有一层或多层。每一层的神经元都接收上一层所有神经元的输出,进行加权求和并通过激活函数处理。深层网络之所以强大,正是因为拥有多个隐藏层,能够提取数据从低级到高级的特征。

- 输出层 (Output Layer):产生最终的预测结果(如分类的类别概率、回归的具体数值)。

2. 工作原理

前馈神经网络的工作过程被称为前向传播 (Forward Propagation),数据像水流一样从左向右流过网络。具体步骤如下:

第一步:加权求和 (Weighted Sum)

对于网络中的任意一个神经元,它会接收来自上一层所有神经元的输出信号 xi 。每个信号都有一个对应的权重 (Weight, wi ),代表该信号的重要性。此外,还有一个偏置 (Bias, b ),类似于线性方程中的截距,用于调整神经元的激活阈值。

神经元首先计算输入信号的线性组合:

神经元首先计算输入信号的线性组合:

z=∑(wi⋅xi)+bz=∑(wi⋅xi)+b

第二步:激活函数 (Activation Function)

计算出的 zz 值会通过一个非线性的激活函数 (Activation Function, ff )。这是神经网络能够拟合复杂非线性关系的关键。如果没有激活函数,无论多少层网络,最终都等价于一个单层的线性模型。

常见的激活函数包括:

- ReLU (Rectified Linear Unit): f(z)=max(0,z) ,目前最常用,能缓解梯度消失问题。

- Sigmoid: 将输出压缩到 (0, 1) 之间,常用于二分类问题的输出层。

- Tanh: 将输出压缩到 (-1, 1) 之间。

- Softmax: 常用于多分类问题的输出层,将输出转化为概率分布。

最终该神经元的输出为:

a=f(z)a=f(z)

第三步:层层传递

当前隐藏层所有神经元的输出 aa ,会作为下一层神经元的输入 xx ,重复上述“加权求和 -> 激活”的过程,直到数据传递到输出层,得到最终的预测结果 y^y^ 。

3. 如何学习?

虽然工作时的数据流是单向的(前馈),但神经网络的训练过程包含两个阶段:

- 前向传播:输入数据,得到预测结果。

- 反向传播 (Backpropagation):

- 计算预测结果与真实标签之间的损失 (Loss)(误差)。

- 利用链式法则,将误差从输出层向输入层反向传递。

- 根据误差对每个权重和偏置的梯度,使用优化算法(如梯度下降)更新参数,使得下一次预测的误差减小。

4. 为什么叫“前馈”?

- 无记忆性:当前的输出只取决于当前的输入,与过去的输入无关(这与循环神经网络 RNN 不同,RNN 有记忆功能)。

- 无环图:其拓扑结构是一个有向无环图 (DAG),信号不会回流到之前的层或自身。

5. 应用场景

由于其通用的函数拟合能力(万能近似定理),前馈神经网络广泛应用于:

- 分类问题:垃圾邮件识别、图像分类、情感分析。

- 回归问题:房价预测、股票趋势分析。

- 特征提取:作为更复杂模型(如卷积神经网络 CNN 的全连接部分)的基础组件。

小编概括一下

前馈神经网络就像是一个多级的信号过滤器。数据进入后,每一层都在尝试通过加权和非线性变换,将数据转换到一个新的空间,使得在这个空间中,不同的类别更容易被区分,或者目标值更容易被预测。尽管结构简单,它是现代深度学习大厦的基石

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...