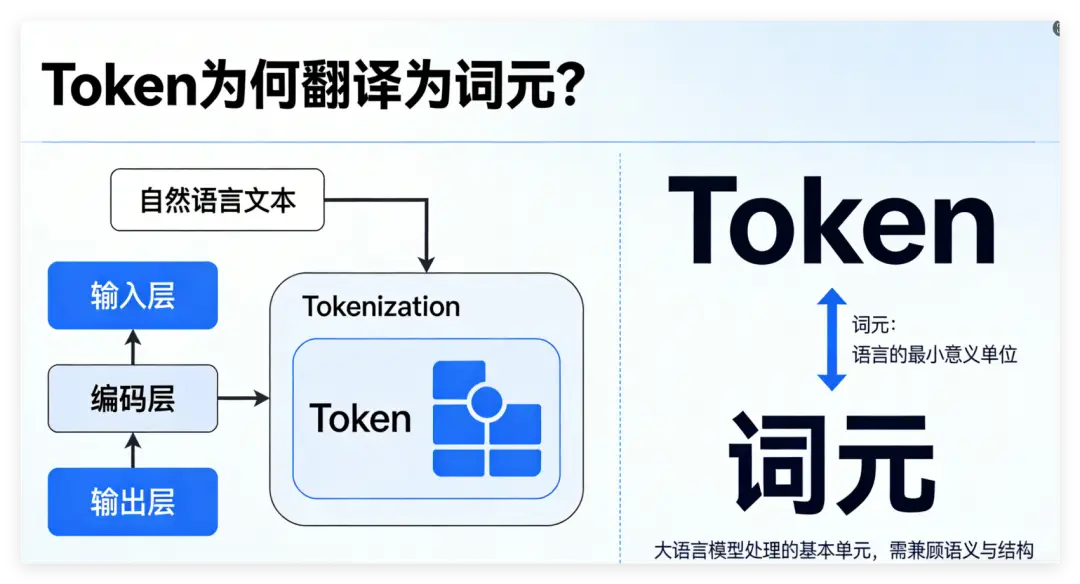

词元(Token)是人工智能处理文本的最小单位。它不等于单词或汉字,而是将文本切割成的碎片,如英文词根、中文单字或常见词组。模型通过词元理解语义、生成内容。其数量直接决定AI处理的成本、速度及上下文长度限制,是连接人类语言与机器计算的关键桥梁。

1. 词元不等于“单词”或“字”

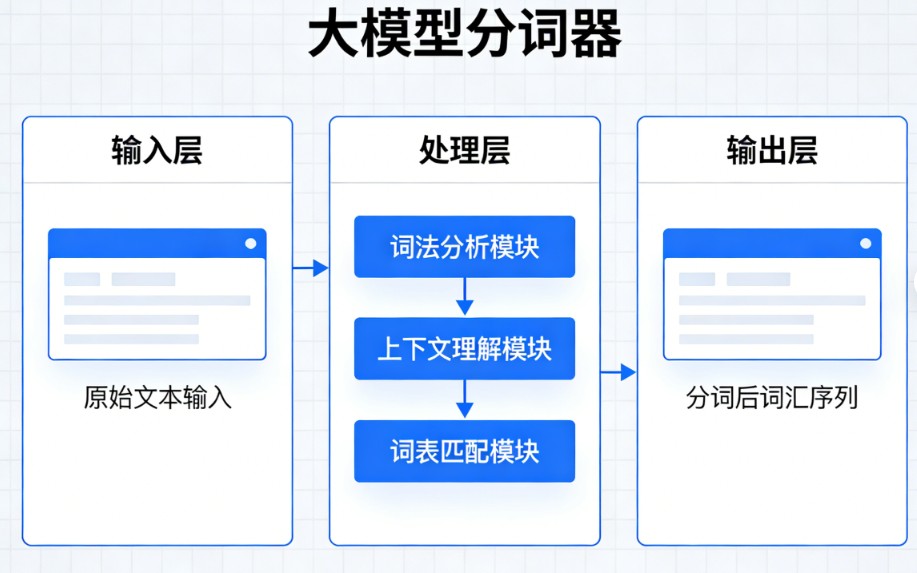

这是最容易产生的误解。词元的划分方式取决于具体的算法(分词器,Tokenizer),它比单纯的“按空格分单词”或“按字符分字”更复杂:

- 在英文中:一个词元可能是一个完整的单词(如

apple),也可能是单词的一部分(如un、believ、able组成unbelievable),甚至可能包含标点符号或空格(如hello)。 - 在中文中:一个词元通常是一个汉字,但也可能是常见的词语组合(如“葡萄”可能被作为一个词元,而不是“葡”和“萄”两个),或者是生僻字被拆解为更小的部件(取决于具体的分词策略,如 Byte-Pair Encoding, BPE)。

举例说明:

假设句子是:”I am eating.”

假设句子是:”I am eating.”

- 人类视角:3个单词 + 1个标点。

- 模型视角(可能的分词结果):

["I", " am", " eat", "ing", "."]- 这里变成了 5个词元。注意

eating被拆成了eat和ing,且am前面带了一个空格。

- 这里变成了 5个词元。注意

2. 为什么要使用词元?

- 处理未知词:如果把整个单词作为最小单位,那么模型遇到没见过的词(比如新造词或拼写错误)就无法处理。将其拆分为更小的片段(子词),模型就能通过已知片段理解未知词的大致含义。

- 平衡效率与粒度:如果按“字”分(中文)或“字母”分(英文),序列会太长,计算量大且难以捕捉语义;如果按“词”分,词汇表会无限大。词元(子词)是在这两者之间的最佳平衡点。

3. 词元与成本、速度的关系

在使用AI服务时,你常听到“按Token计费”或“上下文窗口限制”,这里的Token就是指词元:

- 计费依据:大多数AI接口(如 API)是按照输入和输出的词元数量来收费的,而不是按字数或单词数。

- 速度影响:模型生成内容的速度通常以“词元/秒”来衡量。

- 长度限制:模型的“上下文窗口”(比如 128k)指的是它能同时处理的最大词元数量,而不是字数。一般来说,1000 个词元约等于 750 个英文单词,或者 1.5 到 2 个汉字(具体比例视模型和文本内容而定,中文通常一个汉字对应 1-1.5 个词元,但在某些高效分词器下可能接近 1:1)。

小编归纳一下

词元就是AI眼中的“文字碎片”。它是连接人类语言(单词、句子)和机器数学表示(向量、数字)的桥梁。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...