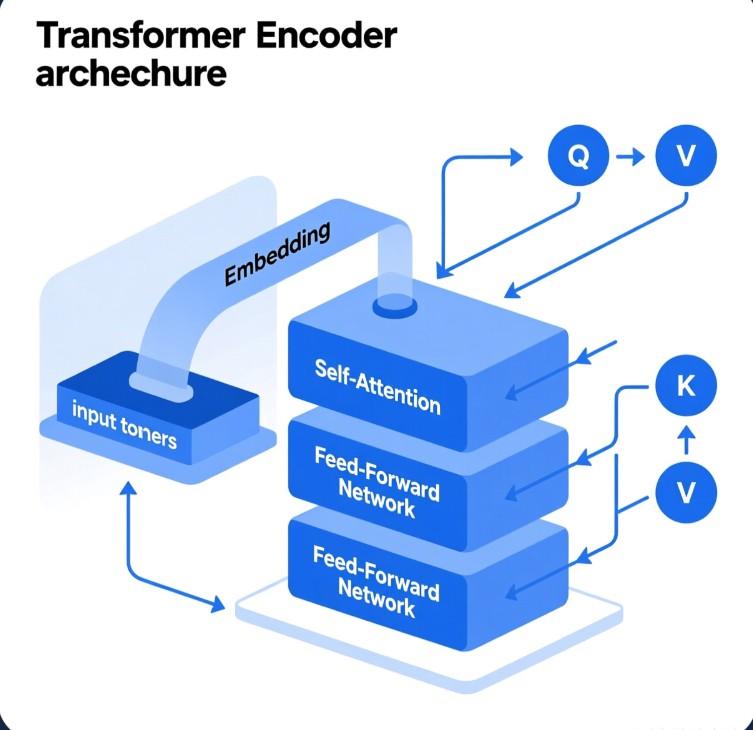

向量嵌入(Vector Embedding,简称“嵌入”)是人工智能和机器学习领域中的一种核心技术,主要用于将离散的对象(如单词、句子、图像、用户ID等)转换为连续的低维向量(即一串数字列表)。

简单来说,就是把现实世界中复杂的信息,“翻译”成计算机容易理解和计算的数学形式。

1. 核心概念

- 从离散到连续:计算机原本很难直接理解“苹果”这个词或一张猫的图片。嵌入技术将这些对象映射到一个多维空间中的点(向量)。例如,“苹果”可能被表示为

[0.12, -0.45, 0.89, ...]。 - 语义保留:这是嵌入最神奇的地方。在生成的向量空间中,语义相似的对象,其向量距离也很近。

- 例如:向量空间中,“国王”和“王后”的距离,会比“国王”和“汽车”的距离近得多。

- 甚至可以进行向量运算:

向量("国王") - 向量("男人") + 向量("女人") ≈ 向量("王后")。

2. 为什么要使用向量嵌入?

计算机擅长处理数字和几何关系,但不擅长理解自然语言的含义或图像的视觉特征。嵌入解决了以下问题:

- 捕捉语义关系:不仅看字面匹配,还能理解含义相近(如“快乐”和“高兴”)。

- 降维:将海量的高维数据(如整个词典的独热编码)压缩到几百或几千维的稠密向量中,节省计算资源。

- 通用性:文本、图片、音频、视频都可以被转化为向量,使得跨模态搜索成为可能(例如用文字搜图片)。

3. 主要应用场景

目前向量嵌入是大模型(LLM)和现代搜索引擎的基石:

- 语义搜索(Semantic Search):

传统的搜索是基于关键词匹配的(你搜“手机”,它找包含“手机”的文章)。

基于嵌入的搜索是基于含义的(你搜“怎么打电话”,它能找到包含“智能手机使用方法”的文章,即使没出现“手机”这个词)。 - 推荐系统:

将用户和商品都转化为向量。如果用户的向量与某商品的向量距离很近,系统就会推荐该商品(如抖音、淘宝的推荐算法)。 - 大语言模型(LLM)的上下文:

当你向AI提问时,你的问题首先会被转化成向量,以便模型理解你的意图并生成回答。 - 聚类与分类:

自动将相似的文档、新闻或客户反馈分组。

4. 常见的嵌入模型

不同的数据类型有不同的模型来生成嵌入:

- 文本:Word2Vec (早期), GloVe, BERT, RoBERTa, 以及现在的专用嵌入模型如

text-embedding-ada-002(OpenAI),bge-m3(智源),m3e等。 - 图像:CLIP (可以同时处理文本和图像向量,实现图文互搜), ResNet, ViT。

5. 一个简单的比喻

想象一个巨大的图书馆:

- 没有嵌入时:图书管理员只能按书名的字母顺序找书。如果你找“关于悲伤的书”,但书名里没有“悲伤”二字,你就找不到。

- 有嵌入时:每本书都被放在一个巨大的多维房间里,位置取决于它的内容。所有关于“悲伤”、“失落”、“痛苦”的书都自动聚在了一起。无论你怎么描述(只要意思对),你都能走到那个区域找到相关的书。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...