AI安全护栏(AI Guardrails)是一套为确保人工智能系统安全、合规、负责任地运行而设计的综合性防护机制。

你可以把它想象成高速公路两旁的护栏。它的核心作用不是限制车辆(AI)的行驶,而是防止其“冲出道路”,确保AI在预定的边界内工作,避免对系统和用户造成伤害。

为什么需要AI安全护栏?

随着AI,特别是生成式AI的快速发展,它在带来巨大便利的同时也引入了新的风险。AI安全护栏正是为了应对这些挑战而生,其必要性主要体现在以下几个方面:

- 保护数据安全与隐私:防止AI在交互过程中泄露个人隐私(如身份证号、电话号码)或企业商业机密。

- 防御外部恶意攻击:抵御针对AI模型的特定攻击,例如“提示词注入”(Prompt Injection),即攻击者通过精心设计的输入诱导AI做出有害行为或泄露信息。

- 确保内容合规与伦理:过滤掉AI生成内容中可能存在的有害信息,如仇恨言论、暴力、偏见、色情低俗内容等,使其符合法律法规和社会伦理。

- 提升系统可靠性:减少AI的“幻觉”(Hallucination),即模型生成看似合理但事实上错误或荒谬的内容,从而维护用户信任。

AI安全护栏如何工作?

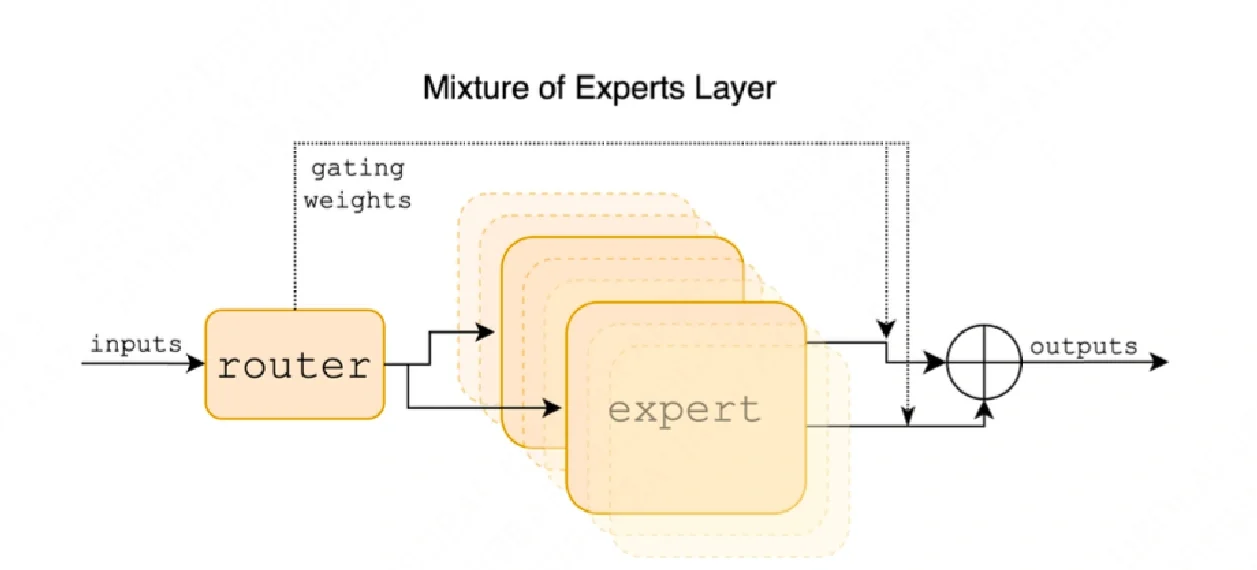

AI安全护栏通常不是一个单一的技术,而是一个多层次、贯穿AI应用全生命周期的防护体系。它主要在两个关键环节发挥作用:

- 输入端防护(Input Guardrails)

在用户的问题或指令发送给AI模型之前,护栏会对其进行扫描和分析。- 风险识别:检查输入内容是否包含恶意攻击代码、违规指令、敏感数据或不当言论。

- 拦截与清洗:一旦识别到风险,护栏会立即拦截该请求,或对其进行清洗后再发送给模型,从源头保障安全。

- 输出端防护(Output Guardrails)

在AI模型生成回答后、展示给用户之前,护栏会再次进行审查。- 内容审核:评估AI生成的文本、图像等内容是否合规,是否存在偏见、毒性或事实性错误。

- 结果修正或拦截:如果输出内容不安全,护栏可以选择不展示、进行修改,或引导模型重新生成一个更安全的回答。

主要类型与应用

AI安全护栏可以从不同维度进行分类,常见的有以下几种类型:

表格

| 护栏类型 | 核心目标 | 典型应用场景 |

|---|---|---|

| 安全护栏 | 保护敏感数据,防止系统被滥用。 | 识别并屏蔽对话中的个人身份信息;防御“越狱”攻击,防止用户绕过模型限制。 |

| 伦理护栏 | 确保输出内容符合社会规范和价值观。 | 过滤仇恨言论、暴力、偏见等不当内容;确保AI回答的公平性和无害性。 |

| 技术护栏 | 保证AI系统行为的稳定性和可预测性。 | 验证AI的输出格式是否正确(如JSON);检查生成代码的安全性;在AI Agent中限制其可执行的操作权限。 |

不同场景下的具体含义

值得注意的是,“AI安全护栏”在不同厂商和场景下,其具体实现和侧重点可能有所不同:

- 通用AI应用防护:像阿里云等云服务商提供的AI安全护栏,通常是一个综合性的SaaS服务,为AI应用提供从内容合规、提示词攻击防御到模型幻觉检测的一站式防护。

- 特定架构安全:在一些更具体的场景中,护栏的概念会更加聚焦。例如,有安全厂商提出在“大模型”与“智能体(Agent)”之间建立专属的指令级安全隔离层,专门防止智能体在执行任务时泄露敏感信息或执行违规指令。这可以看作是针对AI Agent架构的一种 specialized(专业化)安全护栏。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...