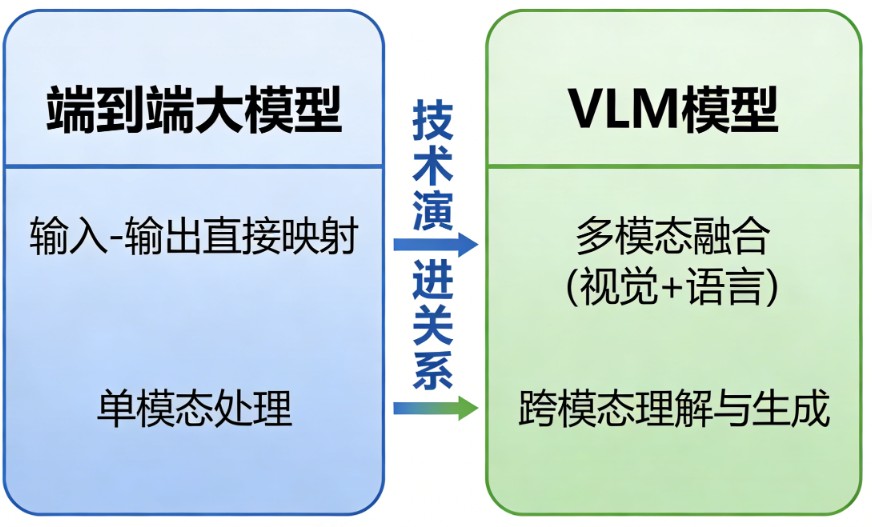

端到端大模型和VLM(视觉语言模型)是两个不同维度、但又在前沿领域(如自动驾驶)相互关联的概念。简单来说,端到端大模型是一种“架构思想”,而VLM是一种具体的“模型类型”。

你可以这样理解:端到端大模型是“怎么做”(How),即一种直接打通输入到输出的设计哲学;而VLM是“做什么”(What),即一种专门用于理解和处理视觉与语言信息的特定模型。

核心概念辨析

端到端大模型 (End-to-End Model)

这是一种架构思想。它的核心是让一个统一的模型,直接从原始输入(如传感器数据)映射到最终输出(如控制指令),中间没有人工设计的、独立的模块。

- 特点:一体化、高效率、模仿人类直觉。

- 类比:一位经验丰富的老司机,看到路况后,不假思索地直接操作方向盘和油门。

VLM (Vision-Language Model)

这是一种具体的模型类型。它的核心能力是同时“看懂”图像和理解语言,实现视觉与文本信息的跨模态理解和推理。

- 特点:多模态、能理解复杂场景的语义(如路牌文字、施工标志)。

- 类比:一位坐在副驾的“教练”或“导航员”,他能看懂复杂的交通标志并用语言告诉你“前方施工,请减速”。

在自动驾驶中的应用关系

在当前的智能驾驶技术发展中,两者常常被结合起来,形成一种“双系统”方案,以兼顾效率与处理复杂场景的能力。

表格

| 维度 | 端到端大模型 (系统1) | VLM (系统2) |

|---|---|---|

| 角色 | 主驾驶员 | 副驾教练 |

| 功能 | 处理95%的常规驾驶场景,快速反应,直接输出驾驶轨迹。 | 处理5%的复杂、罕见场景,提供语义理解和逻辑推理。 |

| 工作方式 | 直觉式、快速。 | 分析式、慢思考。 |

| 举例 | 正常跟车、车道保持。 | 识别临时限速牌、理解交警手势、在暴雨中判断是否停车。 |

理想汽车就采用了这种“端到端+VLM”的双系统架构,其中端到端模型作为主系统,VLM作为辅助系统,共同提升智驾系统的上限。

技术演进:从VLM到VLA

VLM虽然强大,但它主要停留在“理解”和“回答”层面。技术的下一步演进是VLA(视觉-语言-动作模型)。

- VLM (看+说):能看懂图像并用语言描述或回答问题。

- VLA (看+说+做):在VLM的基础上,增加了“动作”能力。它不仅能理解场景,还能直接生成行动策略。

VLA被认为是“端到端2.0”的核心形态。它将感知(VLM的能力)和决策控制(端到端的能力)统一在一个模型中,实现了从“图像输入”到“语义理解”再到“动作输出”的完整闭环。

表格

| 对比项 | 传统/端到端1.0 | VLA (端到端2.0) |

|---|---|---|

| 推理时长 | 能推理未来1-7秒的路况。 | 能推理未来几十秒的路况。 |

| 能力 | 决策和适应性有限。 | 具备更强的类人推理和全局规划能力。 |

| 透明度 | “黑盒”,决策过程难解释。 | 更透明,能向用户解释“为什么这么开”。 |

因此,端到端大模型和VLM并非对立关系,而是相互补充。VLM作为强大的感知和理解模块,正在被整合进更先进的端到端架构中,并向着能看、能想、能做的VLA方向演进。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...