原生多模态大模型(Native Multimodal Large Model)代表了人工智能技术的一次重要架构革新。与传统的多模态模型不同,它从底层设计之初,就是为了统一处理和理解多种信息模态而构建的。

你可以把它想象成一个天生就具备“通感”能力的智能体,它不像传统模型那样需要后天费力地将“眼睛看到”和“耳朵听到”的信息拼凑在一起,而是从一开始就用一种统一的“母语”来思考和理解世界。

核心理念:从“拼接”到“融合”

要理解“原生”,首先要了解传统多模态模型的局限性。

- 传统多模态模型(“拼接式”):

这种模型通常以一个强大的语言模型为核心,然后外挂一个独立的视觉编码器(如CLIP)。处理流程是:图像被视觉编码器转换成特征向量,再通过一个“投影器”翻译成语言模型能理解的格式,最后交给语言模型处理。这种方式就像是让一个语言专家和一个视觉专家通过翻译来沟通,信息在传递中容易损失,且效率不高。 - 原生多模态模型(“融合式”):

它打破了“以语言为中心”的传统架构,从训练伊始就将文本、图像、音频、视频等多种模态的数据,在统一的架构下进行联合学习与建模。所有模态的信息在底层的语义空间里就实现了深度融合与协同优化,从而获得了原生的、一体化的理解与生成能力。

关键技术路径

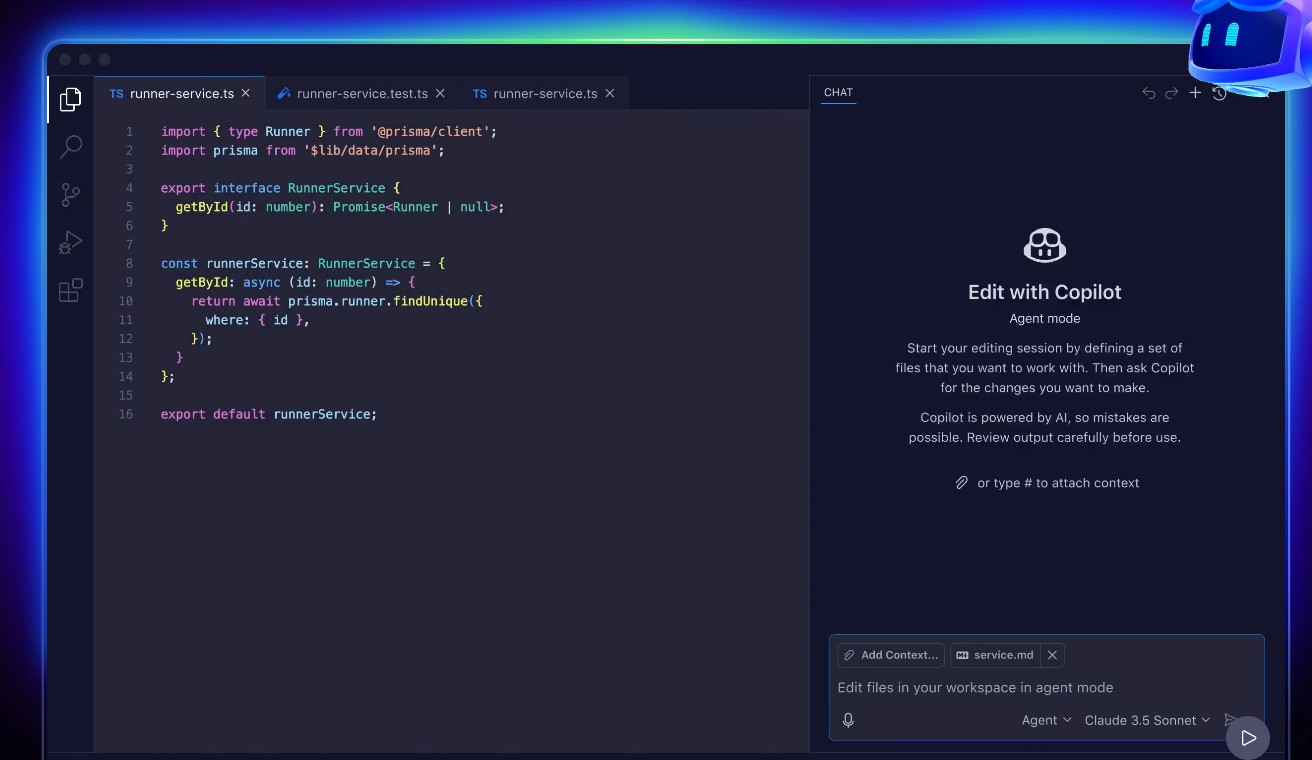

目前,实现原生多模态主要有两种前沿的技术路径,它们都致力于将所有信息转化为统一的格式进行处理。

1. 统一自回归架构

这种路径采用一个统一的自回归模型,从训练开始就融合所有模态的数据。

- 代表案例:百度文心大模型5.0。

- 技术特点:它采用统一的自回归架构,实现了理解与生成的一体化。模型总参数规模超过2.4万亿,通过超稀疏混合专家(MoE)架构,在保持强大能力的同时,有效提升了训练和推理效率。

2. 离散原生自回归架构

这是一种更为彻底的范式,旨在将所有模态都转化为AI的“原生母语”。

- 代表案例:美团 LongCat-Next。

- 技术特点:它通过离散原生分辨率视觉分词器(dNaViT)等技术,将图像、语音和文本统一映射为同源的离散Token(词元)。然后,模型通过纯粹的“下一个Token预测”(Next Token Prediction)范式进行建模,让视觉和语音真正成为AI的“母语”,彻底打破了模态间的隔阂。

优势与应用前景

原生多模态大模型的出现,标志着AI从“以语言为中心”向真正统一感知的综合智能体转变,其优势和应用前景广阔。

表格

| 优势维度 | 具体表现 |

|---|---|

| 能力更强 | 实现更深层次的语义对齐与联合推理,能像人类一样综合运用多种感官信息认知世界。 |

| 效率更高 | 高数据效率降低了对海量标注数据的依赖,加速了AI在医疗、工业质检等专业领域的渗透。 |

| 部署更灵活 | 一些架构(如商汤的NEO)通过优化,能将训练数据需求降低90%,使得模型具备部署到智能手机、车载系统等终端设备的条件。 |

应用前景:

- 具身智能:为机器人提供理解物理世界的基础,使其能更好地与环境交互。

- 智能驾驶:实现对复杂路况、交通标志和突发事件的深度理解与推理。

- AI内容生成:生成角色、场景、风格高度一致的多集短视频等复杂内容。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...