GLM-5V-Turbo 是智谱AI于2026年4月2日发布的首个原生多模态 Coding 基座模型。

简单来说,它的核心突破在于“视觉原生”——它不仅能写代码,还能“看懂”设计稿、截图、网页甚至视频,并直接将其转化为可运行的代码。这标志着大模型编程正式从“纯文本交互”迈向了“视觉交互”时代。

核心定位:为 AI 安上“眼睛”

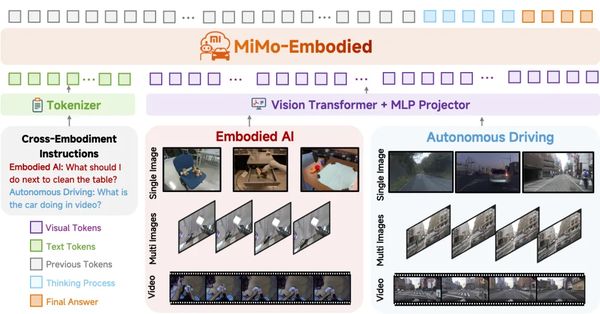

GLM-5V-Turbo 最大的特点是深度融合了视觉与编程能力。与以往在文本模型上简单挂载视觉编码器的做法不同,它从预训练阶段就开始进行文本与视觉的深度融合。

- 所见即所得:你可以直接发给它一张手绘草图、UI设计稿或参考网站的截图,它能理解布局、配色、组件层级和交互逻辑,并生成完整可运行的前端工程。

- GUI 智能体:它具备强大的 GUI Agent 能力,能像人一样自主探索网页、浏览页面结构,甚至通过录屏理解操作流程,进而复现整个站点。

关键技术升级

为了实现上述能力,GLM-5V-Turbo 在四个层面进行了系统性升级:

表格

| 升级维度 | 具体技术细节 |

|---|---|

| 模型架构 | 研发了新一代 CogViT 视觉编码器,在物体识别和空间感知上达到最优;设计了兼容多模态输入的 MTP 结构,提升推理效率。 |

| 训练方法 | 采用了 30+ 任务协同强化学习,同时优化 STEM、视频理解、GUI 操作等任务,避免了单领域训练的不稳定性。 |

| 数据构造 | 针对 Agent 数据稀缺问题,构建了从元素感知到动作预测的多层级体系,并利用合成环境生成了大量可验证的训练数据。 |

| 工具链扩展 | 新增支持多模态搜索、画框、截图、读网页等工具,让 AI 的感知-行动链路从纯文本扩展到了视觉交互。 |

能力表现

GLM-5V-Turbo 在多项权威评测中表现优异,且并未因引入视觉能力而牺牲文本编程水平:

- 多模态能力:在 Design2Code(设计稿转代码)、AndroidWorld(安卓操作)、WebVoyager(网页浏览)等基准测试中,取得了领先表现,优于 Kimi K2.5 和 Claude Opus 4.6 等模型。

- 纯文本编程:在 CC-Bench-V2 等纯文本编程测试中,其表现与纯文本版模型(GLM-5-Turbo)持平甚至略有提升,证明了视觉能力的引入没有导致“灾难性遗忘”。

- 上下文窗口:支持 200k 的超长上下文窗口,能够处理复杂的长文档和视频内容。

生态适配与应用

GLM-5V-Turbo 深度适配了 Claude Code 和智谱自家的 “龙虾” (OpenClaw/AutoClaw) 智能体框架。

- 赋能“龙虾”:接入该模型后,“龙虾”智能体具备了真正的视觉能力,能看懂 K 线图、财报图表,并生成图文并茂的分析报告。

- 行业反馈:内测期间,字节跳动(TRAE)、美团、快手等大厂测评团队均给予了高度评价,认为其在前端复刻和视觉编程场景中极具竞争力。

如何获取

目前,GLM-5V-Turbo 已通过 智谱 MaaS 平台(BigModel)开放接入,开发者可以通过 API 调用,或在智谱官方的 AI 应用中体验。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...