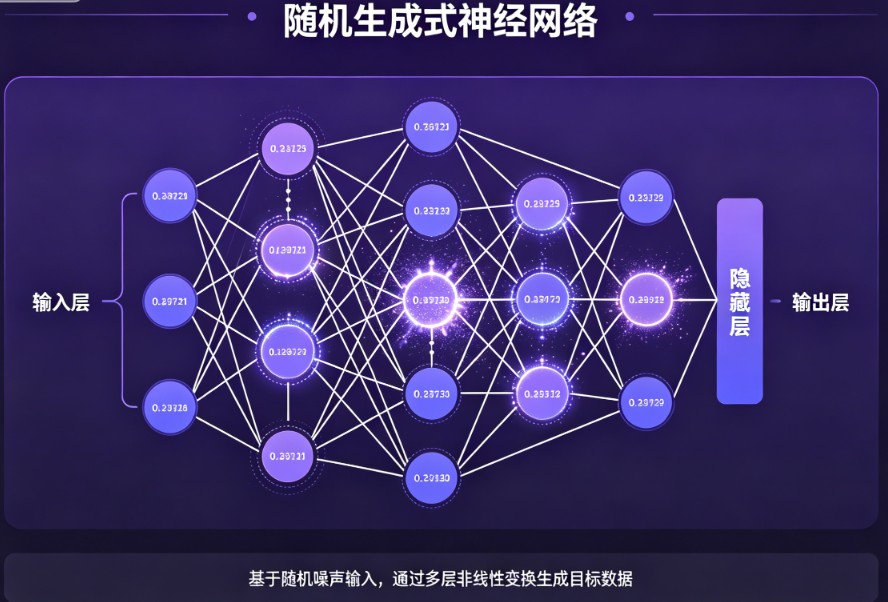

“随机生成式神经网络”并不是一个单一的、标准化的算法名称,而是对利用随机性来生成数据或网络结构具有随机性的一类神经网络的统称。

1. 核心机制:以“随机噪声”为起点的生成模型

- 工作原理:

- 输入:一个服从高斯分布或均匀分布的随机数(噪声)。

- 处理:神经网络(生成器)学习如何将这种无序的随机噪声“映射”到真实数据的分布空间。

- 输出:一张全新的图片或一段文本。

- 典型代表:

2. 网络结构:随机连接的神经网络 (Randomly Wired NNs)

这个维度关注的是神经网络本身的架构是如何构建的。传统的网络(如ResNet)是人工精心设计的,而这一类研究探索使用随机图模型来生成网络结构。

- 核心发现:Facebook AI Research (FAIR) 的研究人员(包括何恺明等)发现,通过随机生成器构建的神经网络结构(RandWire),在图像识别任务上可以达到与人工设计的ResNet-50相当甚至更好的准确率(例如在ImageNet上达到79.1%)。

- 意义:这表明复杂的连接模式不一定需要人工手动设计,随机生成的结构配合神经架构搜索(NAS)也能产生强大的模型。

3. 数学本质:随机神经网络 (Stochastic Neural Networks)

从数学原理上讲,这类网络在神经元或连接中引入了随机变量。

- 特点:

- 随机权重/激活:神经元之间的连接权重或激活函数包含随机过程。

- 避免局部最优:随机性可以帮助模型跳出局部最优解,寻找全局最优。

- 典型代表:

- 玻尔兹曼机 (Boltzmann Machine):一种基于能量模型的随机神经网络,利用统计力学中的玻尔兹曼分布进行抽样。

- Dropout机制:在训练过程中随机“关闭”一部分神经元,这本质上也是一种引入随机性的手段,用于防止过拟合。

概括:随机性在生成式AI中的角色

为了让你更直观地理解,我整理了随机性在不同层面的作用:

表格

| 层面 | 随机性的作用 | 典型应用/算法 |

|---|---|---|

| 输入层 | 创造力的种子。不同的随机种子会生成完全不同的结果(如不同的脸)。 | GANs, Diffusion Models |

| 训练层 | 正则化手段。通过随机丢弃神经元(Dropout)或随机深度,防止模型死记硬背。 | Dropout, Stochastic Depth |

| 结构层 | 架构探索。用随机图算法生成网络拓扑,替代人工设计。 | RandWire, NNSmith |

| 数学层 | 概率建模。模拟生物神经系统的随机放电或能量分布。 | 玻尔兹曼机, 贝叶斯神经网络 |

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...