Token数量确实是决定AI计算资源消耗(算力、显存、时间、成本)的最核心指标。

你可以把Token想象成AI处理信息的“基本积木”或“工作量单位”。无论是你输入的文字,还是AI生成的回答,每一个Token都需要模型进行复杂的数学运算。

1. 计算量:Token越多,模型“思考”越久

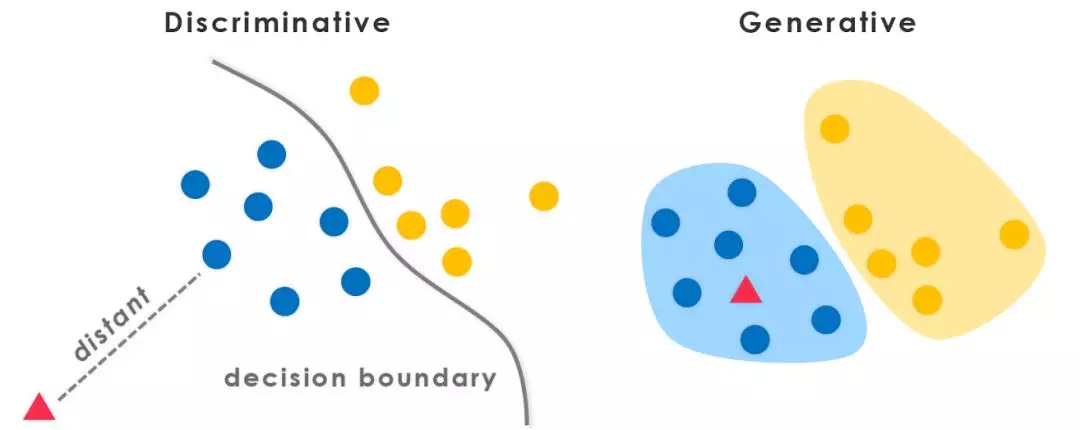

AI 模型(特别是Transformer架构)的工作原理是预测“下一个Token是什么”。

- 输入阶段(编码): 当你发给AI一段话,模型需要把每一个Token转化为向量并进行计算,以理解你的意图。

- 输出阶段(解码): 这是最耗时的部分。AI生成内容是串行的,它必须生成完第1个Token,才能基于前文去计算第 2个Token,以此类推。

- 结论: Token数量直接决定了模型需要进行多少次前向传播计算。生成的Token越多,等待时间越长。

2. 显存占用:Token越多,占用的“内存”越大

这是很多开发者最关心的指标。模型运行时,需要把当前处理的所有信息(输入、中间状态、正在生成的回答)都暂存在显存(VRAM)中。

- KV Cache(键值缓存): 为了让模型记住上下文,系统需要保存之前所有Token的计算状态。随着对话进行,Token 越来越多,这部分占用的显存就会线性增长。

- 直观影响:

- 如果你输入的文本极长(例如一本书),或者要求 AI 写一篇长文,显存占用会迅速飙升。

- 一旦超过显卡的显存上限(例如 8GB 或 24GB),程序就会直接报错(OOM – Out Of Memory)。

- 经验公式: 根据 Phi-3 等模型的测试数据,显存占用与 Token 数大致呈正相关。一个粗略的估算逻辑是:预估显存 ≈ 模型基础显存 + 输入Token数 × 系数 + 输出Token数 × 系数。

3. 算力复杂度:为什么长文本特别“吃”性能?

虽然 Token 增加是线性的,但计算难度的增加往往是非线性的。

- 自注意力机制的代价: 在Transformer架构中,计算“自注意力”时,模型需要计算每个Token与其他所有Token的关系。其计算复杂度通常与Token数量的平方( O(N2) )成正比(尽管在推理阶段通过 KV Cache 优化了,但在训练阶段依然是平方级增长)。

- 这意味着: 当上下文长度翻倍时,所需的计算资源可能会增加 4 倍。这就是为什么处理超长文本(如 100k+ 上下文)对算力要求极高的原因。

4. 金钱成本:Token 是计费的“货币”

对于使用 API(如 GPT-4、Claude)的用户来说,Token直接对应金钱。

- 输入 Token(Prompt): 通常较便宜,因为你只需要计算一次。

- 输出 Token(Completion): 通常比输入贵(例如 GPT-4o 的输出价格通常是输入的 2-3 倍),因为生成过程需要更多的计算步骤和显存读写。

概括:Token与资源的关系表

为了方便你记忆,我整理了这张对照表:

表格

| 资源类型 | 关系描述 | 核心原因 |

|---|---|---|

| 推理时间 (延迟) | 正相关 | 生成是串行的,Token 越多,逐个生成的耗时越长。 |

| 显存占用 (VRAM) | 正相关 | 需要存储 KV Cache(上下文状态),Token 越多占用越大。 |

| 算力需求 (FLOPS) | 指数/平方级增长 | 自注意力机制需要计算 Token 间的相互关系,复杂度极高。 |

| 金钱成本 ( $ ) | 线性增长 | 厂商按 Token 数量计费,输出通常比输入更贵。 |

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...