语音大模型(SpeechLM)是人工智能领域的一次重要技术跃迁,它旨在让AI像人类一样,直接“听懂”并“说出”语言,而非依赖“语音转文字”的中间环节。

简单来说,它是一场从“间接翻译”到“直接理解”的范式革命。

为什么需要语音大模型?

要理解它的价值,首先要看传统语音交互模式的痛点。

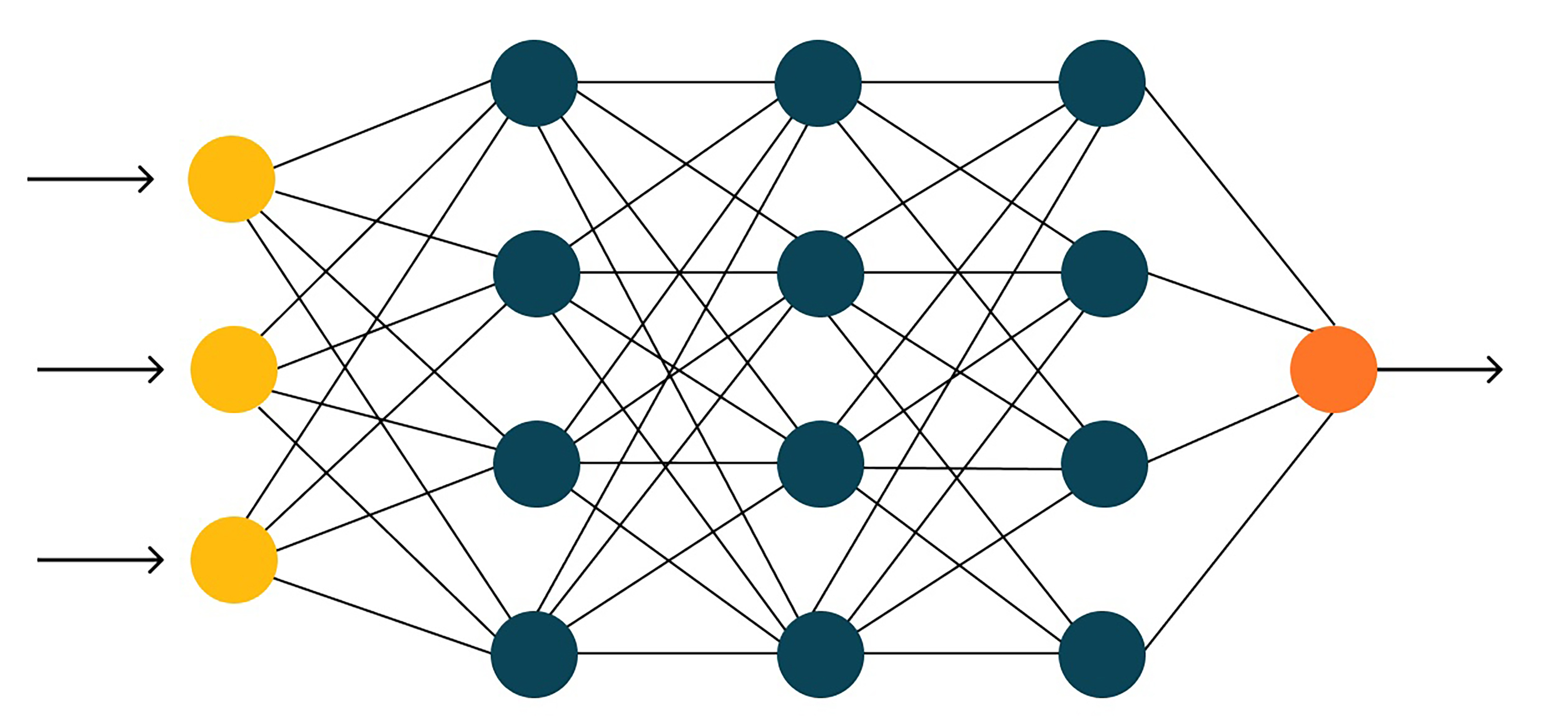

传统的语音系统(如早期的智能助手)通常采用“ASR+LLM+TTS”的串联架构:

这个过程存在三大核心问题:

- 信息丢失:语音中的语气、情感、重音、停顿等丰富信息,在转成文字时会完全丢失。

- 延迟严重:三个步骤串联,每一步都需要时间,导致整体响应慢,交互不自然。

- 错误累积:ASR识别错了,LLM就会理解错,最终TTS输出的内容也必然是错的。

语音大模型如何解决问题?

语音大模型通过端到端(End-to-End)的架构,直接处理和生成语音信号,从根本上解决了上述问题。

它的工作流程更像人类的听觉和发声系统:

- 语音分词器 (Speech Tokenizer):将原始语音波形转换成AI能理解的离散化“语音词元”(Speech Token),这些词元不仅包含语义,也保留了音色、情感等副语言信息。

- 语言模型 (Language Model):作为“大脑”,直接理解这些“语音词元”序列,并进行推理和生成新的“语音词元”序列作为回复。

- 声码器 (Vocoder):将生成的“语音词元”序列还原成高质量的语音波形,直接“说”出来。

这种架构带来了很多优势:

- 保留丰富信息:能理解和生成带有特定情感、口音和韵律的语音。

- 大幅降低延迟:端到端的处理方式减少了中间环节,让对话更流畅、更实时。

- 提升整体效果:避免了错误在多个模块间传递和累积。

语音大模型能做什么?

语音大模型的能力远不止于“听”和“说”,它能实现更深层次的语音智能:

- 超拟人语音对话:支持随时打断、边听边说的全双工交互,体验如同与真人通话。

- 高保真语音克隆:仅需几秒的参考音频,就能完美复刻一个人的音色、语调和说话习惯。

- 情感与副语言识别:能判断说话人是高兴、愤怒还是惊讶,理解“话里有话”的含义。

- 语音分离与翻译:在多人同时说话的嘈杂环境中,能分离出不同人的声音并进行识别或翻译。

- 跨语言自由混说:能识别和理解一句话中混合了多种语言或方言的情况。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...