神经网络(Neural Network),全称人工神经网络(ANN),是一种受生物大脑结构启发而设计的计算模型,也是现代人工智能和深度学习的核心基石。

你可以把它想象成一个由无数简单计算单元(模仿生物神经元)连接而成的复杂网络,它通过模仿人脑处理信息的方式,从海量数据中自主学习规律和模式。

🧠 核心结构:一个“多层级加工厂”

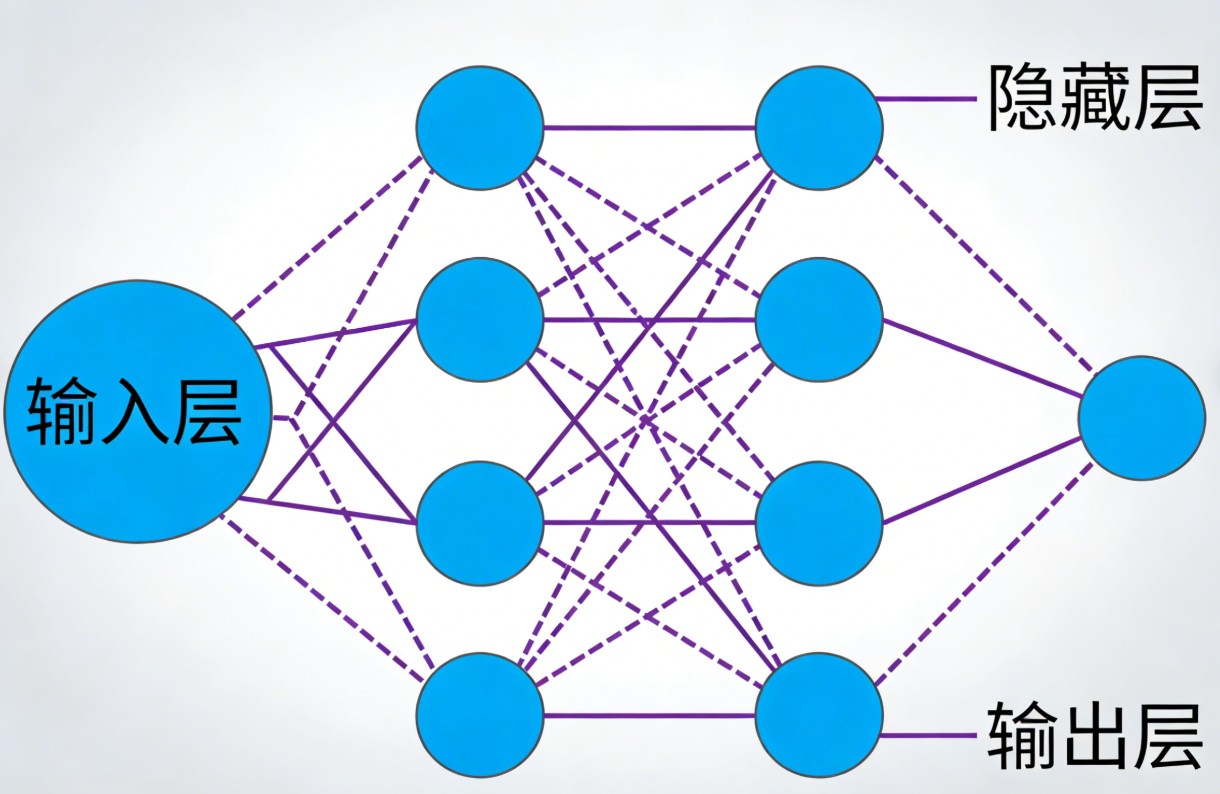

一个典型的神经网络就像一个多层级的信息加工厂,数据从输入到输出,经过层层处理。其基本结构包含三个部分:

- 输入层 (Input Layer)

这是网络的“感官”,负责接收原始数据。例如,在识别猫的图片时,输入层接收的就是图片的每一个像素点的颜色数据。 - 隐藏层 (Hidden Layer)

这是网络的“大脑”,位于输入层和输出层之间,可以有一层或多层(这也是“深度学习”中“深度”的来源)。每一层都包含大量的人工神经元,它们会对上一层传来的数据进行复杂的数学计算和特征提取。- 在识别猫的例子中,第一层隐藏层可能只识别出简单的线条和边缘;第二层会将线条组合成圆形、三角形等简单形状;更深层则可能识别出猫耳朵、胡须等更复杂的特征。

- 输出层 (Output Layer)

这是网络的“决策者”,它综合所有隐藏层处理后的信息,给出最终结果。例如,输出层会计算出“这是猫”的概率是98%,“这不是猫”的概率是2%,从而得出结论。

🎓 工作原理:如何“学习”?

神经网络的学习过程,本质上是一个不断试错和自我修正的过程,主要分为四个步骤:

- 前向传播 (Forward Propagation)

数据从输入层进入,逐层穿过隐藏层进行计算,最终在输出层得到一个预测结果。 - 计算误差 (Error Calculation)

系统会将预测结果与真实答案进行比较。例如,网络预测图片是“狗”,但正确答案是“猫”,这时就会通过一个损失函数(Loss Function)来量化这个预测的误差有多大。 - 反向传播 (Backpropagation)

这是学习的核心。误差信号会从输出层反向传回网络,利用微积分中的链式法则,精确计算出网络中每一个连接(由权重 Weight和偏置 Bias控制)对总误差的“贡献”有多大。 - 更新权重 (Weight Update)

根据反向传播计算出的结果,系统会使用优化算法(如梯度下降)来微调网络中成千上万个连接的权重和偏置,目标是让下一次的预测误差变小。

这个过程会在海量的训练数据上重复成千上万次,最终使得整个网络的参数调整到最优状态,能够准确地对新数据做出判断。

🚀 主要类型与应用

根据结构和功能的不同,神经网络发展出了多种类型,适用于处理不同类型的数据:

表格

| 网络类型 | 特点 | 典型应用 |

|---|---|---|

| 卷积神经网络 (CNN) | 擅长处理网格状数据,如图像。 | 图像识别、人脸识别、自动驾驶中的视觉系统。 |

| 循环神经网络 (RNN) | 擅长处理序列数据,能“记住”之前的信息。 | 语音识别、机器翻译、文本生成。 |

| Transformer | 并行处理能力极强,能捕捉长距离依赖关系。 | 大语言模型(如ChatGPT)、高级自然语言处理。 |

🏆 里程碑意义

人工神经网络的基础性研究获得了科学界的最高认可。2024年的诺贝尔物理学奖就授予了约翰·霍普菲尔德(John Hopfield)和杰弗里·欣顿(Geoffrey Hinton),以表彰他们在使用人工神经网络进行机器学习方面的基础性发现和发明。他们的工作为当今人工智能的蓬勃发展奠定了至关重要的理论基础。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...