AI偏见(AI Bias)是指人工智能系统在处理数据、进行决策或生成内容时,对某些个人、群体或概念产生系统性、不公平的歧视或偏好。

简单来说,AI偏见就像是给算法戴上了一副“有色眼镜”,使其无法客观、中立地看待世界。这并非因为AI产生了自主意识或主观恶意,而是因为它从人类创造的数据中“学习”并“继承”了我们社会中已有的偏见,有时甚至会将其放大。

AI偏见从何而来?

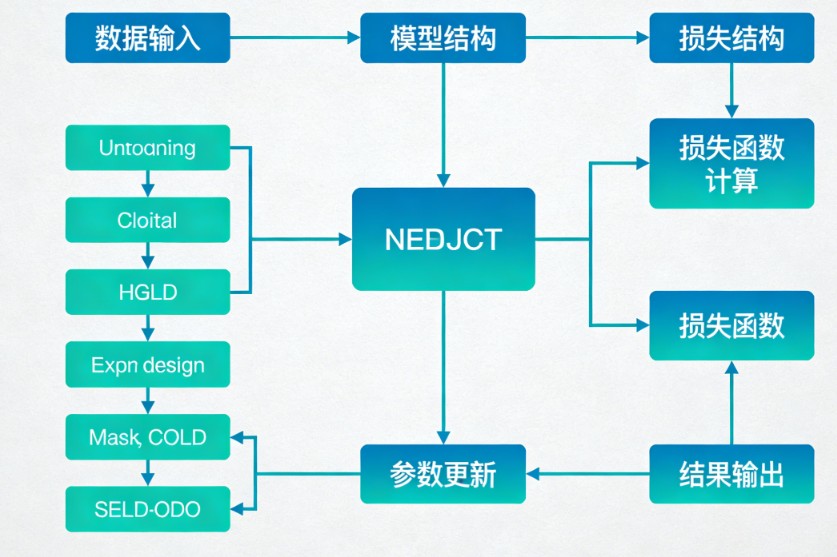

AI偏见的根源主要在于数据和算法设计,可以归结为以下几个层面:

- 数据偏见 (Data Bias):这是最主要的来源。AI模型通过分析海量数据进行学习,如果这些数据本身就反映了人类社会的历史不公、刻板印象或代表性不足,AI就会将这些偏见内化。

- 历史偏见:训练数据反映了过去的不平等。例如,用过去十年以男性为主的简历数据训练招聘AI,它可能会学会偏好男性求职者。

- 代表性偏见:数据集中某些群体(如特定种族、性别)的样本过少,导致模型对这些群体的识别或处理能力较差。

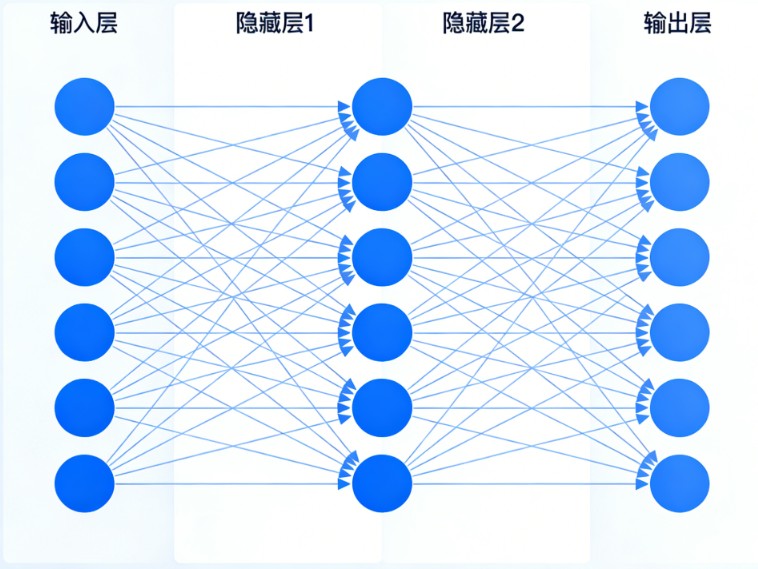

- 算法设计偏见 (Algorithmic Bias):算法的设计者在选择模型、定义目标或选择特征时,可能会无意中引入偏见。例如,选择的算法模型与要解决的问题不匹配,也可能导致不公平的结果。

- 交互偏见 (Interaction Bias):AI在与用户的互动中持续学习,用户的反馈和行为也可能强化其已有的偏见。例如,社交平台算法根据用户的点击偏好推送信息,可能将用户困在“信息茧房”中,加剧观点的极化。

AI偏见有哪些表现形式?

AI偏见在现实世界中有多种多样的表现,以下是一些常见的类型:

表格

| 偏见类型 | 表现说明 | 现实案例 |

|---|---|---|

| 种族偏见 | 系统对特定种族或族裔群体产生不公平对待。 | 面部识别系统在识别深色皮肤人群时准确率显著低于浅色皮肤人群。 |

| 性别偏见 | 算法偏好某一性别,或强化性别刻板印象。 | 亚马逊的AI招聘工具因训练数据中男性简历居多,而自动降低包含“女性”相关词汇的简历评分。 |

| 文化/语言偏见 | 系统对非主流文化或语言群体存在“隐形歧视”。 | 图像生成AI在输入“非洲村庄”时,倾向于生成茅草屋等刻板印象图像;在处理小语种时表现远差于英语。 |

| 社会经济偏见 | 算法偏向高收入群体,对低收入群体不利。 | 英国A-Level考试评分算法因参考学校历史表现,导致来自低收入地区的学生分数被系统性压低。 |

AI偏见如何影响我们的生活?

AI偏见的影响已经渗透到社会的方方面面,可能对个人权利和社会公平造成严重冲击:

- 就业歧视:在简历筛选环节,AI可能会不公平地淘汰某些群体的求职者,剥夺他们平等的就业机会。

- 司法不公:用于预测犯罪风险或评估假释资格的AI系统,可能因历史逮捕数据中的偏见,导致对少数族裔社区的过度执法和更严苛的判决。

- 医疗服务差异:用于辅助诊断的AI模型如果主要基于特定人群(如白人男性)的数据训练,可能在诊断女性或有色人种患者时出现误诊或延误。

- 固化刻板印象:生成式AI创作的图像和文本,如果频繁再现“CEO是白人男性”、“护士是女性”等刻板印象,会潜移默化地影响公众认知,加剧社会偏见。

如何应对AI偏见?

解决AI偏见是一个复杂的系统性工程,需要多方共同努力:

- 数据层面:在训练AI时,确保数据的多样性和代表性,并对数据进行清洗,尽可能去除其中蕴含的偏见。

- 算法层面:提高算法的透明度和可解释性,让人们能够理解AI的决策过程。同时,建立算法审查机制,定期评估其公平性。

- 团队层面:组建多元化的AI开发团队,不同背景的成员能更容易地从多角度发现潜在的偏见问题。

- 法规层面:制定和完善相关法律法规,对高风险的AI应用进行监管,保障公民的合法权益不受算法歧视。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...