监督微调(Supervised Fine-Tuning,简称 SFT)是大语言模型(LLM)训练流程中的关键一步。它的核心作用是将一个知识渊博但“不懂人话”的基座模型(Base Model),改造成一个能听懂指令、流畅对话的指令模型(Instruct Model)。

如果把大模型的训练比作培养一个学生:

- 预训练(Pre-training):相当于让学生博览群书,学习海量的知识和语言规则,成为一个“书呆子”。

- 监督微调(SFT):则相当于请一位老师,拿着一本本写有“问题”和“标准答案”的练习册,手把手教这个学生如何根据问题给出正确的回答。

为什么需要SFT?

经过预训练的基座模型,其核心能力是“预测下一个词”,而不是“回答问题”。

- 基座模型的表现:如果你问它“中国的首都是哪里?”,它可能会续写成“…这个问题在地理考试中很常见,日本的首都是东京…”,因为它只是在根据上文续写文本。

- SFT的目标:通过SFT,我们教会模型理解“这是一个问题,你需要直接给出答案”的模式。经过SFT后,模型就能正确地回答“中国的首都是北京。”

SFT是如何工作的?

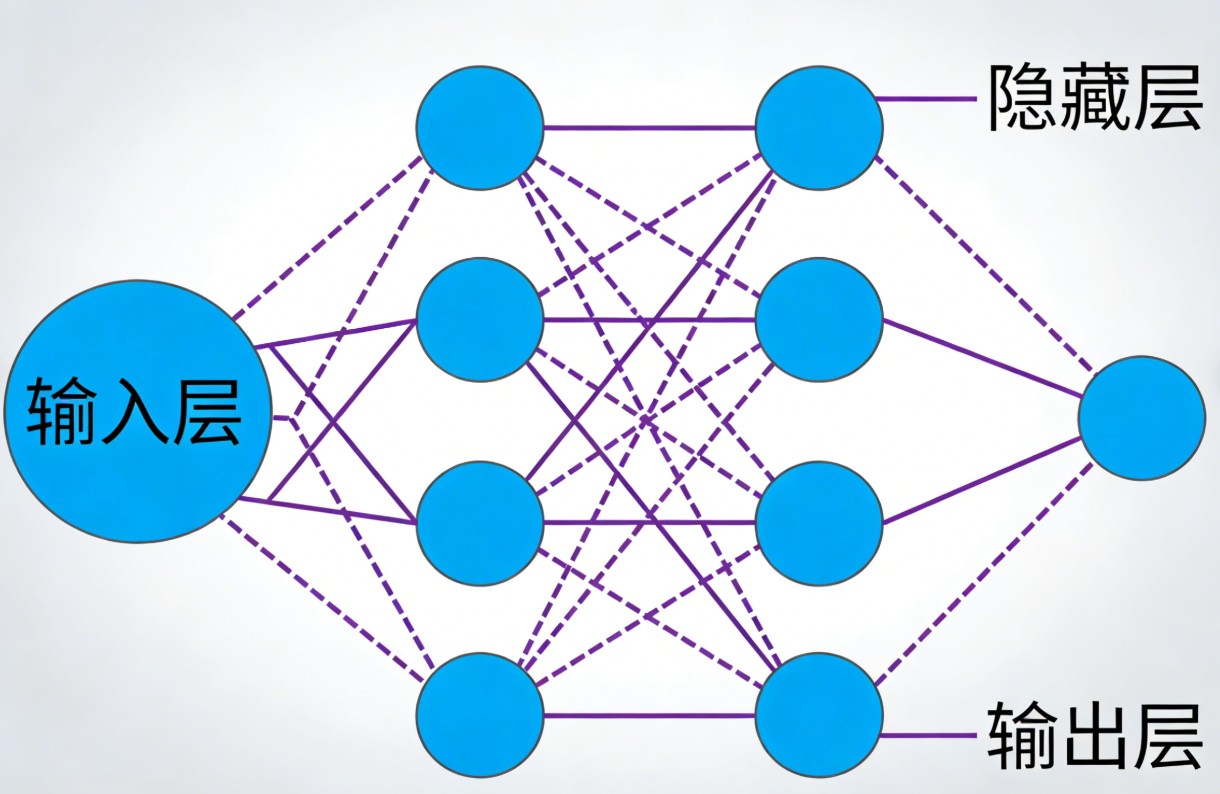

SFT的过程是一个典型的监督学习流程,主要包含三个要素:

- 数据准备

准备大量高质量的“指令-回答”配对数据(Instruction-Response Pairs)。这些数据通常由人工精心编写,格式如下:- 输入 (Prompt):“请把‘今天天气真好’翻译成英文。”

- 输出 (Response):“The weather is very good today.”

- 模型训练

将这些配对数据输入到预训练好的基座模型中。模型会尝试根据指令生成回答,然后将其与标准答案进行比较,计算两者之间的差异(即损失,通常使用交叉熵损失函数)。 - 参数更新

通过反向传播算法,根据计算出的损失来调整模型内部的参数,目标是让模型下一次的回答更接近标准答案。

SFT与其他技术的区别

为了更清晰地理解SFT,可以将其与几个相关概念进行对比:

表格

| 对比维度 | 监督微调 (SFT) | 预训练 (Pre-training) | 人类反馈强化学习 (RLHF) |

|---|---|---|---|

| 核心目标 | 教会模型遵循指令 | 学习通用知识和语言规律 | 让模型输出更符合人类偏好(有用、无害) |

| 训练数据 | 高质量的“指令-回答”对 | 海量的、无标注的文本 | 人类对多个模型回答的偏好排序 |

| 学习方式 | 监督学习 (有标准答案) | 自监督学习 (预测下一个词) | 强化学习 (根据奖励信号优化) |

SFT的演进与挑战

SFT是连接通用大模型与行业应用的桥梁,但它也面临着一些挑战和发展:

- 数据是关键:SFT的效果高度依赖于数据的质量而非数量。研究表明,少量(如1万条)高质量、多样化的样本,其效果可能优于大量低质量数据。

- 作为RLHF的基础:在更先进的训练流程中,SFT通常是第一步。它先让模型具备基础的指令遵循能力,然后在此基础上进行RLHF,进一步优化模型的回答质量,使其更符合人类的价值观和偏好。

- 高效微调方法:全参数SFT计算成本高昂。因此,像 LoRA 这样的参数高效微调(PEFT)方法应运而生,它只训练模型中一小部分新增的参数,在保证效果的同时大幅降低了资源消耗。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...