奖励模型训练(Reward Model Training)是人工智能,特别是大型语言模型(LLM)对齐(Alignment)过程中的一个关键环节。它的核心目标是训练出一个能够模仿人类偏好、对AI生成内容进行打分的“裁判”模型。

你可以把它想象成在训练一位“AI导师”:

- 基座模型:像一个知识渊博但不懂规矩的学生。

- 奖励模型:就是这位“导师”,它的任务不是自己回答问题,而是评判“学生”的回答好坏,并给出分数。这个分数就是“奖励信号”,用于指导“学生”不断改进。

为什么需要奖励模型?

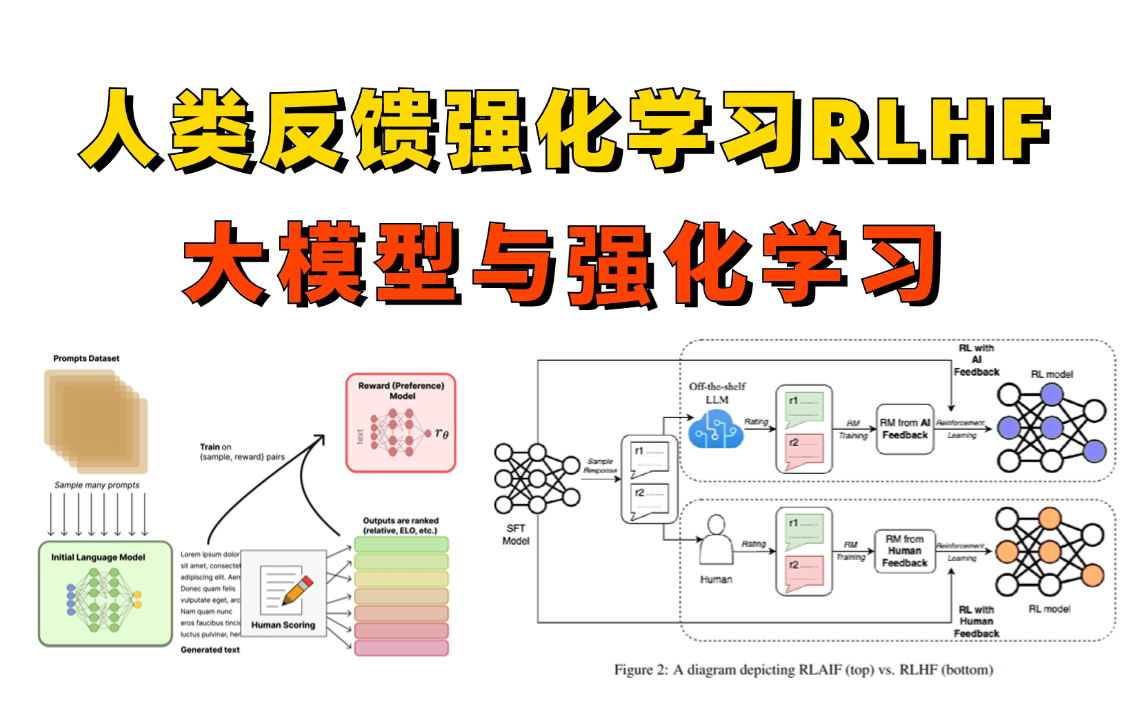

在人类反馈强化学习(RLHF)的流程中,直接让AI根据人类的反馈进行学习是非常困难且低效的。人类的反馈是主观且复杂的,难以用一个简单的数学公式来定义“什么是好回答”。

奖励模型的作用就是将这个复杂、主观的人类偏好,转化成一个稳定、可计算的数值信号。这样,在后续的强化学习阶段,AI模型就可以通过最大化这个“奖励分数”来自动优化自己的输出,使其更符合人类的期望。

奖励模型是如何训练的?

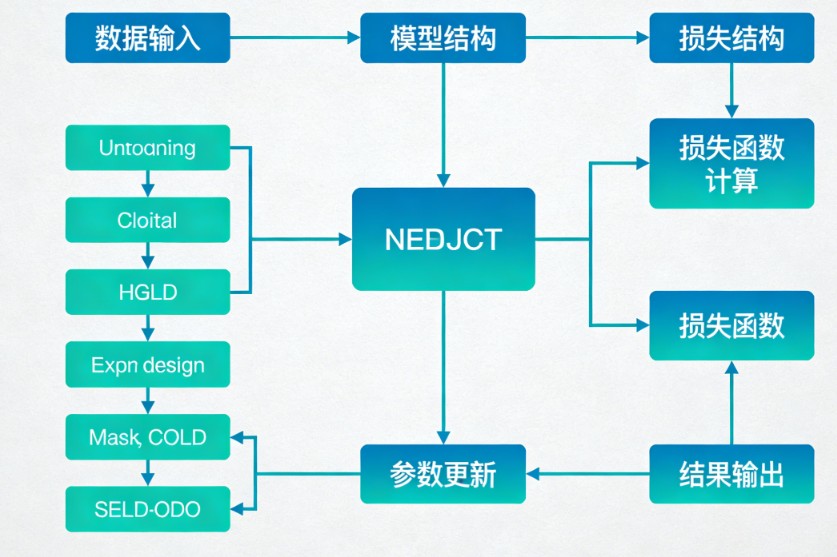

奖励模型的训练是一个典型的监督学习过程,它依赖于高质量的“人类偏好数据”。整个过程可以分解为以下几个步骤:

- 数据准备:收集偏好对

首先,针对同一个问题(Prompt),让一个已经过初步训练的模型(如SFT模型)生成多个不同的回答。然后,由人工标注员对这些回答进行比较和排序,判断哪个更好(Chosen),哪个更差(Rejected)。这样就形成了一个“问题-好回答-差回答”的三元组数据。 - 模型架构:在基座上增加“评分头”

奖励模型通常是在一个已有的语言模型(如SFT模型)基础上构建的。具体做法是,保留原模型作为“编码器”来理解输入文本,然后移除原有的文本生成部分,替换上一个简单的线性层(即“价值头”或Value Head)。这个“头”的作用是将模型对文本的理解压缩成一个单一的数值——奖励分数。 - 训练目标:学习区分好坏

训练的目标非常明确:让模型给“好回答”打出比“差回答”更高的分数。这通常通过一个对比损失函数(Contrastive Loss)来实现,例如:loss = -log(sigmoid(score_chosen - score_rejected))

这个公式的含义是,模型会不断调整自身参数,以最大化好回答与差回答之间的分数差距。

挑战与前沿探索

尽管奖励模型至关重要,但其训练过程也面临一些挑战和新的研究方向:

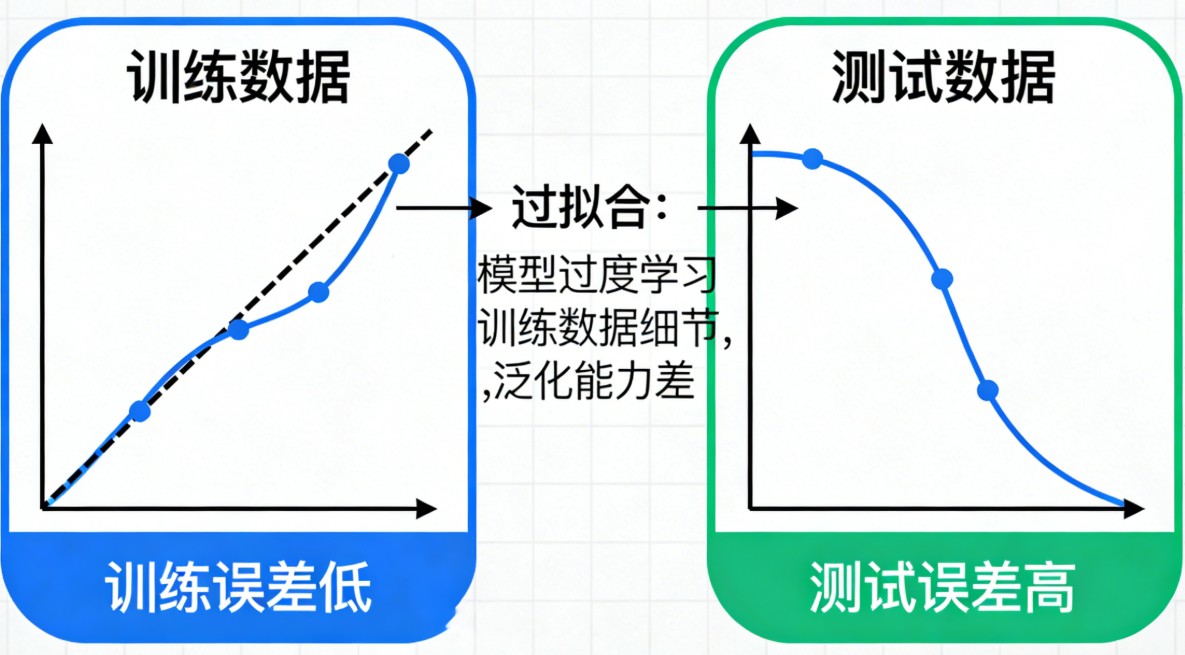

- 学习肤浅规律(偏见):奖励模型可能会学习到一些错误的“捷径”。例如,如果训练数据中高质量的答案普遍更长,模型可能会错误地认为“长度=质量”,从而偏好冗长但空洞的回答,而忽略了内容的准确性。

- 过程监督(Process Supervision):为了应对复杂推理任务(如数学解题),研究者提出了过程奖励模型(PRM)。与只评判最终答案的“结果监督”不同,PRM会对模型推理的每一步进行监督和打分,从而更精准地引导模型学会正确的思考路径。

- 用自然语言定义奖励:一些最新的研究(如RewardAnything)尝试不再让模型从海量例子中猜测偏好,而是直接用自然语言告诉它评判原则,例如“请确保事实准确性高于一切”。这种方法让奖励模型能更灵活、更明确地理解人类多样化的意图。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...