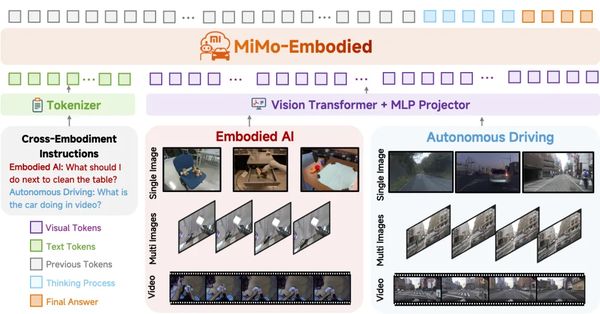

它是业界首个成功打通自动驾驶与具身智能的跨域基座模型,旨在解决机器人与车辆在认知与能力上的互通问题,标志着通用具身智能研究从“垂直领域专用”向“跨域能力协同”迈出了关键一步。

核心突破:跨域统一建模

传统的AI模型通常将“室内机器人智能”与“室外驾驶智能”分开训练,而MiMo-Embodied首次实现了两者的统一建模。它不仅能理解室内环境,还能处理复杂的室外交通场景,实现了全场景的智能支撑。

表格

| 能力维度 | 核心任务 | 具体功能 |

|---|---|---|

| 具身智能 (室内/机器人) | 可供性推理 | 判断物体能否被操作(如:杯子能否被拿起)。 |

| 任务规划 | 拆解复杂指令(如:“打扫桌子”分解为具体步骤)。 | |

| 空间理解 | 理解三维空间关系及环境布局。 | |

| 自动驾驶 (室外/车辆) | 环境感知 | 识别动态环境中的物体与状态。 |

| 状态预测 | 预测交通参与者(车、人)的下一步行为。 | |

| 驾驶规划 | 在复杂路况下做出驾驶决策。 |

技术架构与训练策略

MiMo-Embodied基于MiMo-VL架构,采用了“四阶段渐进式”训练策略,以确保模型在真实环境中的可靠性:

- 具身与通用知识奠基:建立基础的视觉语言理解和具身推理能力。

- 自动驾驶知识注入:重点训练多视角空间推理和复杂交通场景分析。

- 思维链(CoT)推理强化:增强模型处理复杂多步问题的逻辑推理能力。

- 强化学习(RL)优化:采用GRPO算法,通过奖励信号进一步提升模型的精确度和可靠性。

性能表现

在涵盖感知、决策与规划的29项核心基准测试中,MiMo-Embodied展现了领先的性能:

- 具身智能领域:在 17个 基准测试中取得 SOTA(当前最优)成绩,特别是在可供性预测和任务规划方面。

- 自动驾驶领域:在 12个 基准测试中实现全链路性能突破,包括复杂交通场景分析。

- 双向赋能:实验证明,经过具身智能训练的模型在自动驾驶决策任务中准确率提升了 19%,而自动驾驶预训练模型在家庭场景任务规划效率上提高了 23%。

开源与生态

- 开源协议:MIT 协议。

- 获取方式:模型权重与代码已在 Hugging Face 和 GitHub 上全面开放,支持开发者进行二次开发。

- 核心团队:由小米“AI天才少女”罗福莉(Xiaomi MiMo大模型负责人)带领团队研发,陈龙担任项目负责人,郝孝帅为第一作者。

MiMo-Embodied 的发布是小米“人车家全生态”战略的重要技术拼图,它让AI从单纯的“认知工具”向能够与物理世界交互的“行动主体”进化。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...