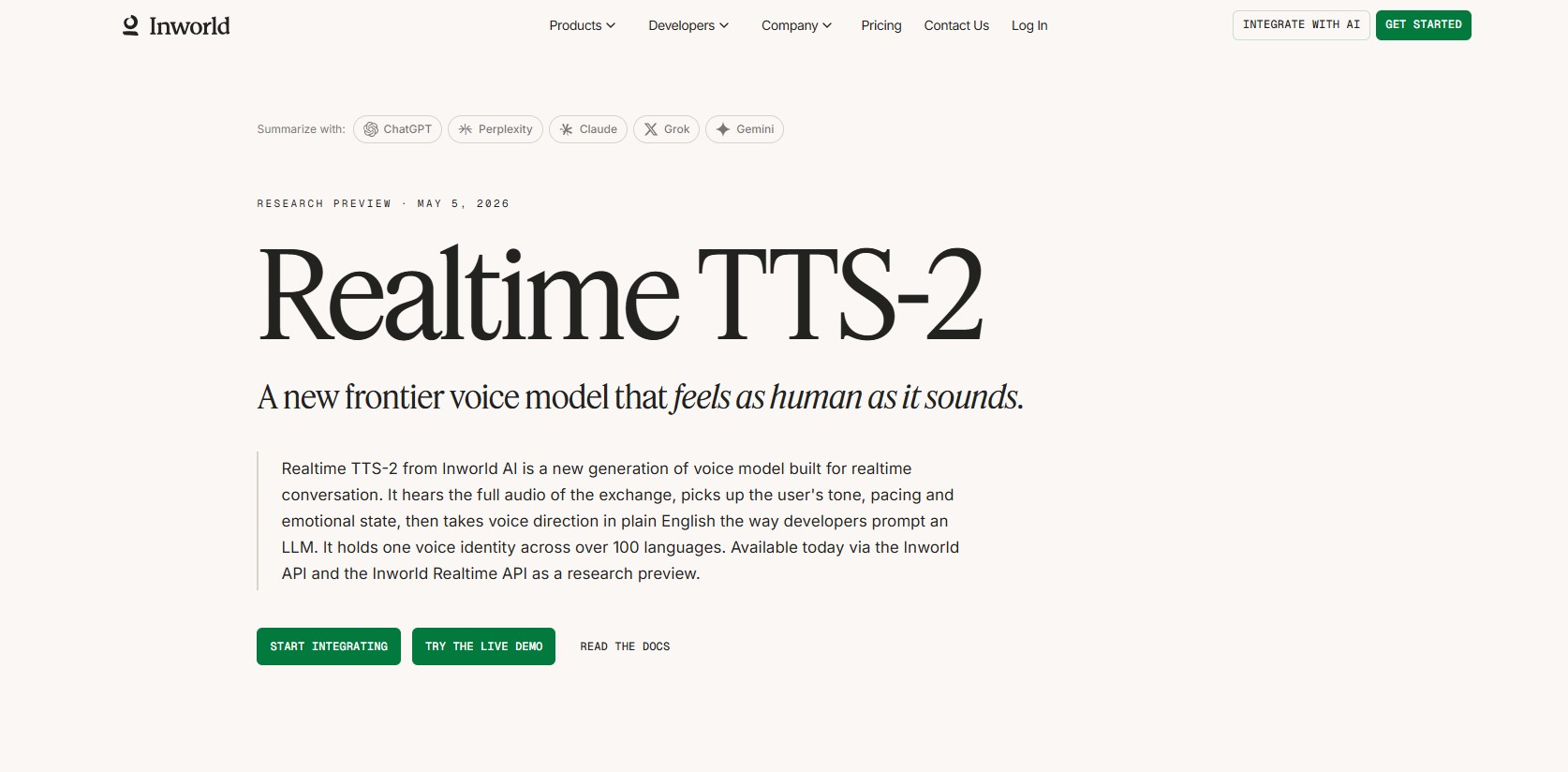

Realtime TTS-2是由Inworld AI发布的一款实时对话语音合成模型。它并非传统的“文本转语音”工具,而是通过闭环系统架构,能够实时感知对话中的音频上下文(如用户的语调、节奏和情感),从而生成极具拟人化特征和上下文连贯性的语音回应,标志着AI语音交互从单纯的“音质竞争”迈向了“行为层创新”。

Realtime TTS-2核心功能与特点

Realtime TTS-2 的核心在于其对“对话感”的极致追求,主要通过以下四大功能实现:

- 对话感知 (Conversational Awareness)

模型能接收并理解前几轮对话的实际音频,而不仅仅是文字转录。这使得它能捕捉到用户语气中的情感信息(如沮丧或轻松),并据此动态调整自身回应的语调、节奏和风格,实现真正的对话连贯性。 - 语音方向控制 (Voice Direction)

开发者可以通过自然语言提示(如“tired but warm, like she just got home”)或内联标签(如[laugh],[sigh])来精准、实时地指导语音的情感、语速和风格,突破了传统固定情绪标签的限制。 - 跨语言一致性 (Crosslingual Consistency)

支持超过 100 种语言,并能保持同一个声音身份(Voice Identity)在不同语言间的高度统一。它甚至支持在同一个句子内进行中、英、日等语言的无缝切换,无需为不同语言管理不同的音色。 - 高级声纹设计 (Advanced Voice Design)

允许开发者仅通过一段文字描述(如“warm low-pitch female with slight rasp, late-30s”)即可生成并保存一个全新的、可复用的自定义声音,无需提供任何参考音频样本,实现了零样本(Zero-shot)声纹设计。

Realtime TTS-2技术原理

Realtime TTS-2 的技术优势主要体现在其创新的架构上:

- 端到端统一架构:将“倾听-思考-表达”整合在一个持久的 WebSocket 连接中,确保模型在训练和推理时都能 conditioning 于完整的对话音频上下文。

- Token 级流式生成:支持服务器发送事件(SSE)流式传输,实现 Token 级别的音频输出,确保极低的响应延迟(200毫秒内),满足实时交互的需求。

- 拟人化特征:生成的语音中自然地包含了停顿、语气词、呼吸声等细节,使其听起来更像真人。

Realtime TTS-2同类竞品对比

根据第三方评测机构Artificial Analysis的Speech Arena 榜单,Realtime TTS-2在语音质量方面表现突出。

表格

| 对比维度 | Inworld Realtime TTS-2 | ElevenLabs | OpenAI GPT-4o Audio |

|---|---|---|---|

| 语音质量排名 | #1 | #3 | #5 |

| 自然对话式表达 | ✅ | 未明确 | ✅ |

| 实时低延迟 | ✅ | 未明确 | 未明确 |

| 多轮音频感知 | ✅ | ❌ | ✅ |

Realtime TTS-2如何使用

开发者可以通过 Inworld 提供的 API 和 SDK 来集成 Realtime TTS-2。

- 接入方式:通过 Inworld API或Inworld Realtime API 进行调用,也提供了Node.js和Python的 SDK。

- 兼容性:该模型支持OpenAI Realtime协议,这意味着现有的OpenAI Realtime客户端只需更改URL即可接入。

- 声音设计:在调用时,开发者可以选择使用参考音频进行声音克隆,或通过文字 Prompt 直接创建新声音,并选择其稳定性模式(Expressive / Balanced / Stable)。

Realtime TTS-2的项目地址

- 项目官网:https://inworld.ai/blog/realtime-tts-2

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...