混合注意力机制(Hybrid Attention Mechanism)是当前大模型架构演进中的一个关键突破,旨在解决传统标准注意力机制在处理超长序列时计算成本过高(O(n²))的瓶颈。

简单来说,它不再单一地使用某一种注意力计算方式,而是将标准注意力(Standard/Full Attention)与线性注意力(Linear Attention)(如 Gated DeltaNet、Lightning Attention 等)结合在一个模型中,通过“取长补短”来实现性能与效率的平衡。

这一机制已成为阿里 Qwen3.5、月之暗面Kimi Linear、MiniMax-M1等前沿模型的核心技术底座。

核心原理:为什么要“混合”?

为了理解混合注意力,我们需要先看两种基础机制的优缺点:

表格

| 机制类型 | 特点 | 优点 | 缺点 |

|---|---|---|---|

| 标准注意力 (Full/Softmax Attention) | 传统的 Transformer 架构核心。 | 精度高:能精准捕捉上下文中的复杂依赖关系,模型效果好。 | 速度慢:计算复杂度随文本长度呈平方级增长(O(n²)),处理长文时显存占用极大。 |

| 线性注意力 (Linear Attention) | 如 Gated DeltaNet、Lightning Attention。 | 速度快:计算复杂度是线性的(O(n)),推理速度极快,显存占用低,适合超长文本。 | 精度略损:在捕捉某些复杂的局部细节或全局关联时,效果可能不如标准注意力。 |

混合注意力机制的逻辑在于:

大部分内容其实不需要复杂的“标准注意力”来处理,用高效的“线性注意力”就够了;但在关键节点(如每隔几层),插入一层“标准注意力”来确保模型的理解精度不下降。

大部分内容其实不需要复杂的“标准注意力”来处理,用高效的“线性注意力”就够了;但在关键节点(如每隔几层),插入一层“标准注意力”来确保模型的理解精度不下降。

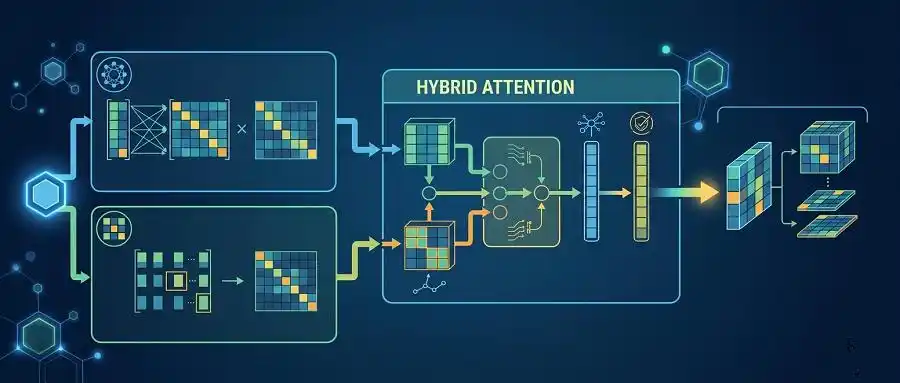

技术实现:它是如何工作的?

混合注意力机制通常采用交替堆叠的方式。模型并不是在每一层都用同一种机制,而是按照特定的比例进行组合。

- 交替部署:模型以特定的比例(如 3:1 或 1:7)交替部署线性注意力层和标准注意力层。

- 线性层(主力):负责处理大部分序列信息,利用其状态记忆机制(State Memory),大幅减少KV Cache的大小,实现“无限”上下文长度。

- 标准层(校准):定期插入,用于“校准”模型状态,确保关键信息的精准捕捉。

- 门控机制(Gating):许多混合机制(如 Gated DeltaNet)引入了门控单元。在注意力计算发生前,通过可学习的门控动态评估信息,决定信息的流向或处理方式,进一步实现计算的稀疏化,提升效率。

主流模型的混合策略对比

不同的厂商根据自身需求,采用了不同的混合比例和具体技术路线:

表格

| 模型/架构 | 混合策略/比例 | 核心技术 | 优势表现 |

|---|---|---|---|

| Qwen3.5 (阿里) | 3:1 (3层线性+1层标准) | Gated DeltaNet + Gated Attention | 256K上下文下解码吞吐量提升 19倍,原生支持视觉理解。 |

| Kimi Linear (月之暗面) | 3:1 (3层 KDA + 1层 MLA) | Kimi Delta Attention (KDA) | 在减少内存占用的同时,质量超越全注意力模型,适合长文本推理。 |

| MiniMax-M1 | 1:7 (1层标准+7层线性) | Lightning Attention | 原生支持100万 Token上下文,推理成本大幅降低。 |

| Ring-Linear (蚂蚁) | 1:7 | Lightning Linear | 深度推理场景成本仅为同尺寸稠密模型的 1/10。 |

带来的核心价值

混合注意力机制的普及,为大模型带来了三个维度的质变:

- 推理速度与成本优化

在长文本生成和推理阶段,混合架构显著降低了计算量(FLOPs)。例如 MiniMax-M1在100K长度生成时,FLOPs 消耗仅为DeepSeek R1的 25%。这意味着更低的运营成本和更快的响应速度。 - 多模态能力的原生支持

阿里Qwen3.5的实践表明,混合注意力机制(特别是Gated DeltaNet + Gated Attention的组合)有助于模型更好地进行跨模态对齐,使其能够原生支持视觉、音频等多模态数据的理解,而不仅仅是处理文本。

概括

混合注意力机制是大模型从“暴力堆算力”向“架构创新提效”转型的标志性技术。它通过“线性注意力打底,标准注意力点睛”的策略,成功打破了Transformer架构在长文本处理上的效率魔咒,是当前构建超长上下文(Long-Context)和低成本推理大模型的首选方案。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...