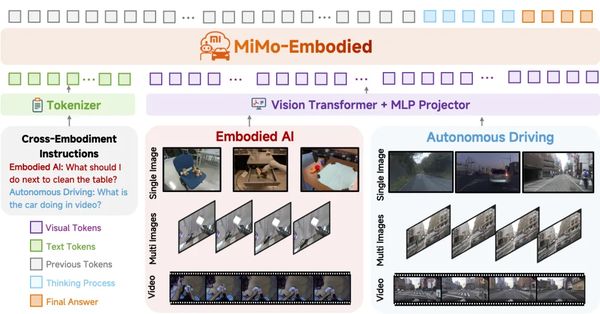

MiMo-V2.5是小米于正式开源的原生全模态大模型。与专注于复杂推理的Pro版本不同,MiMo-V2.5主打全能感知与高性价比,能够像人类一样同时“看、听、读”,并迅速做出反应。它被视为覆盖绝大多数通用智能体(Agent)场景的主力模型。

MiMo-V2.5核心定位

MiMo-V2.5不仅仅是“能看图”的语言模型,而是从底层架构上融合了视觉与听觉能力的原生全模态模型。

- 全感官支持:它配备了专用的视觉编码器(7.29亿参数 ViT)和音频编码器(2.61亿参数),能够深度理解文本、图像、视频和音频。

- 应用场景:非常适合需要处理多模态信息的任务,如视频内容分析、图表解读、语音交互等。

⚡ 极速响应与高性价比

如果说Pro版是“深思熟虑的专家”,那么MiMo-V2.5就是“反应敏捷的通才”。

- 推理速度更快:相比Pro版,MiMo-V2.5的平均推理速度更高,能够更迅速地响应用户请求,特别适合对时延敏感的任务。

- 成本更低:在 API调用成本上,MiMo-V2.5比Pro版更便宜(Credits 消耗仅为 Pro 版的一半),且在通用任务中展现出极高的Token效率。例如,在达到同等效果时,其Token消耗量比Meta的Muse Spark模型节省约 50%。

MiMo-V2.5硬核技术规格

MiMo-V2.5性能表现

尽管体积比Pro版小,MiMo-V2.5在通用能力上依然强悍:

- 评测成绩:在 Claw-Eval通用子集评测中得分62.3,在VideoMME、CharXiv等视频与图表分析评测中,表现逼近甚至超越了部分顶级闭源模型。

- 能力跃升:相比上一代MiMo-V2-Omni,其跨模态推理和视频理解能力有显著提升;相比MiMo-V2-Pro,它在通用 Agent任务上表现更优且成本更低。

MiMo-V2.5开源与获取

- 开源协议:同样采用MIT协议,允许全球开发者免费商用、微调和二次开发。

- 硬件适配:与 Pro 版一样,MiMo-V2.5也在开源首日完成了与阿里平头哥、AMD、百度昆仑芯等主流芯片厂商的适配。

- 激励计划:同样包含在小米的 “MiMo Orbit”计划中,开发者可申请免费Token额度进行体验与开发。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...