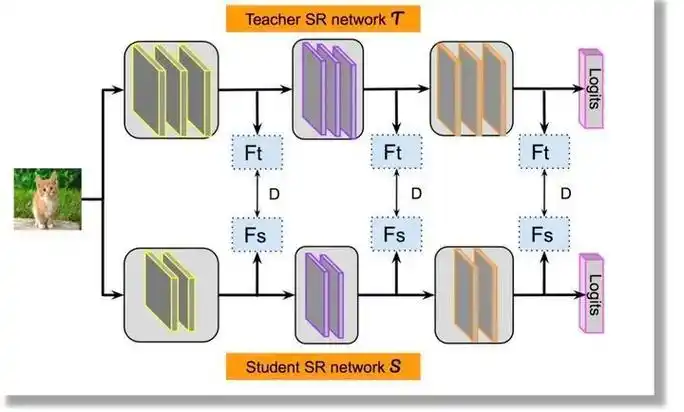

特征蒸馏(Feature Distillation)是一种先进的知识蒸馏技术,它的核心思想是让学生模型不仅学习教师模型的最终输出,更要模仿其内部的“思考过程”——即中间层的特征表示。

如果说传统的知识蒸馏是“授人以鱼”(学习最终答案),那么特征蒸馏就是“授人以渔”(学习分析问题的方法)。它通过让学生模型的内部特征图(Feature Maps)逼近教师模型的对应特征,从而将教师模型强大的特征提取和表征能力迁移给学生。

核心原理与工作流程

特征蒸馏的关键在于如何让学生模型(通常更小、更简单)有效地学习教师模型(通常更大、更复杂)的内部特征。其基本工作流程包含以下几个关键环节:

- 选取特征层

从教师模型和学生模型中选择一个或多个中间层作为知识迁移的“桥梁”。这些层通常是卷积神经网络的卷积层或Transformer的注意力层输出,它们包含了从边缘、纹理到高级语义等不同抽象级别的信息。 - 特征对齐(Adaptation)

由于学生和教师模型的架构和容量不同,它们对应层的特征图在通道数(Channels)和空间尺寸(Height & Width)上往往不一致。因此,需要一个“适配器”(Adaptor)来对齐这些维度。- 通道对齐:最常用的方法是使用

1x1卷积层,将学生特征图的通道数映射到与教师特征图相同。 - 空间对齐:如果空间尺寸不同,可以通过上采样(Upsample)或下采样(Downsample)来匹配。

- 通道对齐:最常用的方法是使用

- 计算蒸馏损失(Distillation Loss)

在特征对齐后,通过一个距离度量函数来计算学生特征与教师特征之间的差异。最常用的是均方误差(MSE)损失,它直接衡量两个特征图在每个点上的数值差异。 - 联合优化

学生模型的最终训练目标是同时优化其自身的任务损失(如分类任务的交叉熵损失L_task)和特征蒸馏损失(L_distill)。总损失函数通常表示为:L_total = L_task + α * L_distill

其中,α是一个超参数,用于平衡任务学习和知识模仿的重要性。

主要方法演进

特征蒸馏技术不断发展,衍生出多种更高效、更鲁棒的方法。

表格

| 方法类型 | 核心思想 | 优点与挑战 |

|---|---|---|

| 基础特征蒸馏 | 直接让学生特征图的数值逼近教师特征图(如FitNets)。 | 优点:实现简单,信息量大。 挑战:点对点约束过强,易受背景噪声干扰。 |

| 注意力迁移 (AT) | 让学生学习教师的“注意力图”(Attention Map),即特征图中哪些区域更重要,而非具体数值。 | 优点:更稳定,能聚焦于前景物体。 挑战:需要额外计算注意力图。 |

| 关系蒸馏 (Relation-based) | 让学生学习教师特征中不同样本或不同通道之间的“关系”(如相似度矩阵),而非单个特征本身。 | 优点:捕捉全局结构信息,鲁棒性强。 挑战:计算和显存开销较大。 |

| 通道蒸馏 (CWD) | 将每个通道的特征图视为一个概率分布,让学生学习教师通道的分布特性,实现语义对齐。 | 优点:自动抑制背景,聚焦语义主体。 挑战:计算KL散度比MSE稍复杂。 |

| 前景背景分离 (FGD) | 显式地将特征图分为前景(Focal)和背景(Global)两部分,并分别进行蒸馏。 | 优点:解决目标检测中的正负样本不平衡问题。 挑战:需要设计注意力机制来分离前景背景。 |

典型应用场景

特征蒸馏因其强大的表征学习能力,在多个领域有广泛应用:

- 目标检测:这是特征蒸馏最成功的应用之一。通过蒸馏中间特征图,可以让学生模型保留关键的空间信息和物体边界,显著提升定位精度。

- 模型压缩:将大型CNN或Vision Transformer的知识蒸馏到轻量级网络(如MobileNet)中,使其能在手机、IoT等边缘设备上高效运行。

- Transformer压缩:例如将BERT蒸馏为DistilBERT或TinyBERT,通过匹配注意力矩阵和隐藏状态,让学生模型保留对语言细微差别的理解能力。

- 跨模态学习:将从图像数据上训练的教师模型的特征,蒸馏到处理深度图或红外数据的学生模型中,帮助学生模型学习更鲁棒的特征。

如何选择适合的蒸馏方法

选择哪种特征蒸馏方法,取决于你的具体任务和需求:

- 通用图像分类

对于常规的图像分类任务,基础特征蒸馏或注意力迁移(AT)是不错的起点。它们实现相对简单,能有效提升学生模型的泛化能力。 - 目标检测等密集预测任务

这类任务对空间信息极其敏感。前景背景分离(FGD)和通道蒸馏(CWD)是更优的选择,因为它们能有效处理背景噪声和正负样本不平衡问题,让学生模型更专注于学习物体本身。 - 追求极致鲁棒性

如果你希望学生模型能学习到数据内在的、与具体像素无关的结构化知识,关系蒸馏是最佳选择。它尤其适用于小样本学习或数据分布变化较大的场景。 - 模型量化在进行模型量化(Quantization)时,可以采用量化特征蒸馏(QFD)。它使用量化后的特征作为教师信号,能更有效地帮助学生模型适应低精度计算,恢复量化带来的精度损失。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...