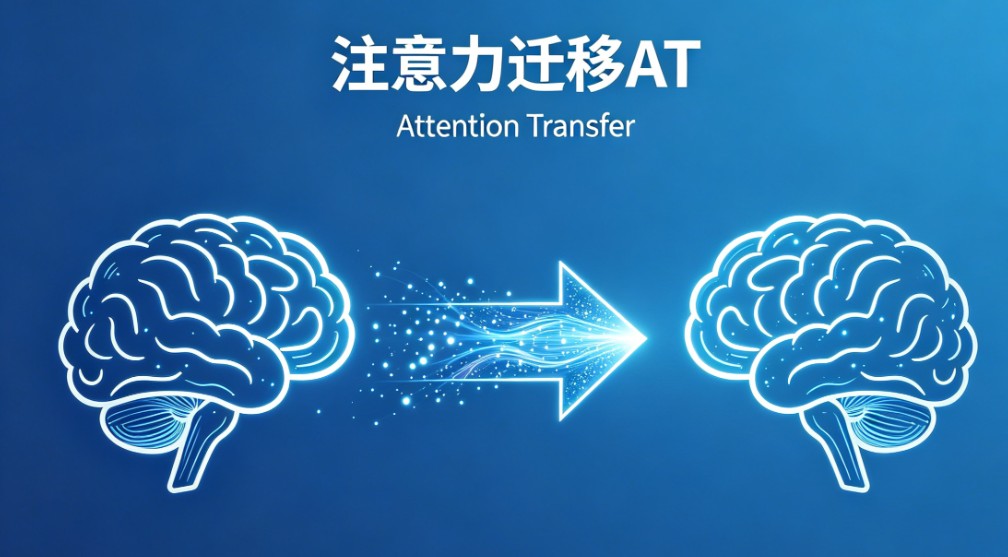

注意力迁移(Attention Transfer, AT)是特征蒸馏技术中一个非常关键且高效的分支。它的核心理念非常直观:与其让学生模型死记硬背教师模型复杂的特征数值,不如让它学习教师模型“关注哪里”。

这种方法认为,神经网络中间层的“注意力图”(Attention Map)蕴含了比原始特征更本质的结构化知识——即模型认为图像中哪些区域是重要的(如物体主体),哪些是无关紧要的(如背景噪声)。

核心原理:从“学数值”到“学重点”

在传统的特征蒸馏中,我们强制学生模型的输出特征图在数值上逼近教师模型(点对点匹配)。但这存在两个问题:

- 容量不匹配:学生模型太小,很难完美复刻大模型的复杂特征分布。

- 背景干扰:教师模型的特征图中包含大量背景信息,强制对齐可能会让学生模型“分心”,学习到不必要的噪声。

注意力迁移解决了这些问题:

它通过计算教师模型的注意力图(通常基于激活值的绝对值或梯度),生成一个二值化或加权的掩码(Mask)。然后,损失函数会惩罚学生模型在教师“不关注”区域的激活,并鼓励其在教师“关注”区域的响应。

它通过计算教师模型的注意力图(通常基于激活值的绝对值或梯度),生成一个二值化或加权的掩码(Mask)。然后,损失函数会惩罚学生模型在教师“不关注”区域的激活,并鼓励其在教师“关注”区域的响应。

数学表达(简化版):

如果AT是教师模型的注意力图, FS是学生模型的特征图,注意力迁移损失通常旨在最大化学生特征在教师注意力区域的响应:

如果AT是教师模型的注意力图, FS是学生模型的特征图,注意力迁移损失通常旨在最大化学生特征在教师注意力区域的响应:

或者更简单地,直接让学生生成的注意力图AS逼近教师的 AT :

主要技术流派

根据生成注意力图的方式不同,主要分为以下几类:

表格

| 方法类型 | 核心机制 | 适用场景 |

|---|---|---|

| 基于激活的迁移 | 利用特征图中神经元的激活强度(如绝对值、平方和)来生成注意力图。激活越强,代表越重要。 | 图像分类、通用目标检测。这是最常用且实现最简单的方法。 |

| 基于梯度的迁移 | 利用输出对特征的梯度来生成注意力图,反映特征对最终预测结果的敏感度。 | 需要极高解释性的任务,但在实际蒸馏中效果往往不如基于激活的方法稳定。 |

| 标签引导注意力 | 利用标签信息(如分割掩码)来指导注意力的生成,强制模型关注特定类别的区域。 | 语义分割(如车道线检测),能显著提升模型对边缘和细节的捕捉能力。 |

| 多尺度/分层迁移 | 在不同层级的特征图上分别计算注意力并进行迁移(如浅层关注纹理,深层关注语义)。 | 复杂场景理解,如北航提出的SAGN网络,通过多尺度注意力提升分割精度。 |

进阶应用:从“空间”到“语义”

随着技术的发展,注意力迁移的概念也在不断进化,特别是在最新的CVPR 2025等研究中,出现了更高级的形态:

- 原理:通过计算参考图像和生成图像在自注意力层的差异,引导生成过程。

- 效果:例如在“Attention Distillation”方法中,研究者利用预训练扩散网络的自注意力特征,将参考图像的风格或纹理忠实地转移到新图像中,而无需重新训练模型。

- 多模态理解迁移

在像X2I这样的框架中,注意力迁移被用来将多模态大语言模型(MLLM)的理解能力“注入”到图像生成模型(DiT)中。- 原理:通过逆KL散度蒸馏注意力输出,让学生模型(图像生成器)学会像教师模型(多模态理解器)那样去“理解”文本和图像的对应关系。

为什么它比传统蒸馏更好?

- 抗噪性强:自动过滤背景干扰,让学生模型聚焦于前景物体,这在COCO等复杂背景的数据集上效果尤为明显(AP值可提升4%~6%)。

- 收敛更快:给学生一个明确的“搜索方向”,减少了模型在无关区域摸索的时间。

- 泛化性好:学习到的“关注机制”往往比具体的特征数值更具通用性,即使学生模型结构差异很大,也能有效迁移。

实践建议

如果你正在做模型压缩或知识蒸馏:

- 首选基于激活的方法:计算开销小,实现简单(通常只需几行代码计算特征图的均值或最大值),且效果稳健。

- 结合输出层蒸馏:不要只依赖注意力迁移,将其与Logits蒸馏(软标签)结合使用,通常能获得最佳效果。

- 注意权重平衡:注意力损失只是辅助,主任务损失(如分类Loss)仍应占主导地位。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...