Hy-MT1.5-1.8B-1.25bit是腾讯混元团队正式开源的一款极致轻量化的离线翻译模型。这款模型最大的亮点在于它通过先进的量化压缩技术,将原本需要数GB内存的翻译大模型压缩至440MB 左右,使得普通智能手机也能在完全不联网的情况下,流畅运行高质量的实时翻译。

Hy-MT1.5-1.8B-1.25bit核心亮点

- 体积极小 (仅 440MB):

原始模型(Hy-MT1.5-1.8B)在 FP16 精度下占用约 3.3GB 内存,对于手机端来说负担较重。腾讯团队采用了 1.25-bit 极致量化压缩技术(基于 Sherry 稀疏高效三值量化方案),将模型体积缩小了约 87.5%,最终仅需 440MB 存储空间。 - 全离线运行:

模型完全在本地设备(如安卓手机)上运行,无需消耗网络流量,也不依赖云端服务器。这意味着在飞机上、地铁里或出国漫游时,依然可以使用。 - 隐私安全:

由于翻译过程完全在本地处理,用户的聊天记录、邮件内容或个人隐私信息不会上传到云端,实现了“零隐私暴露”。

Hy-MT1.5-1.8B-1.25bit性能表现

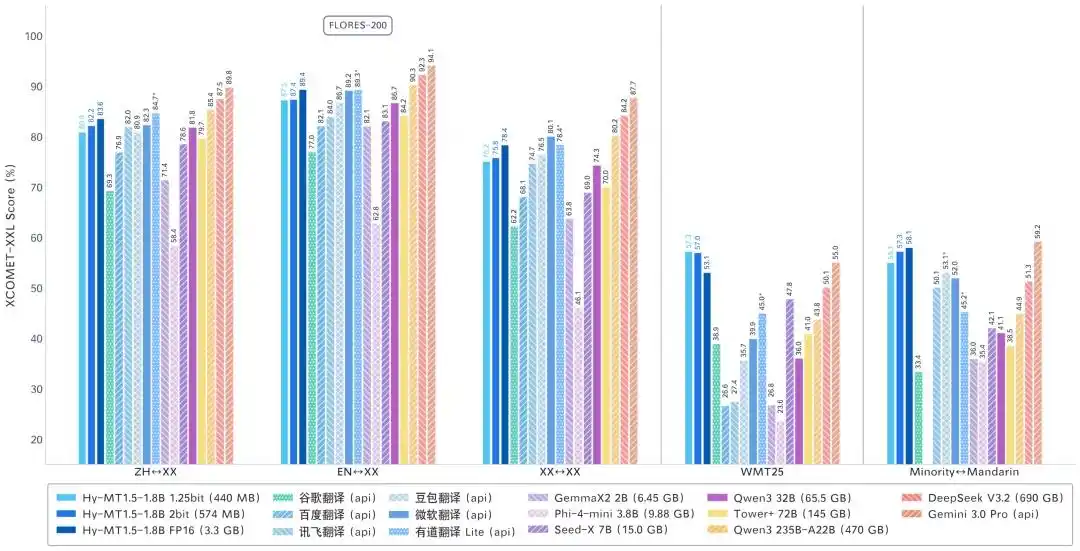

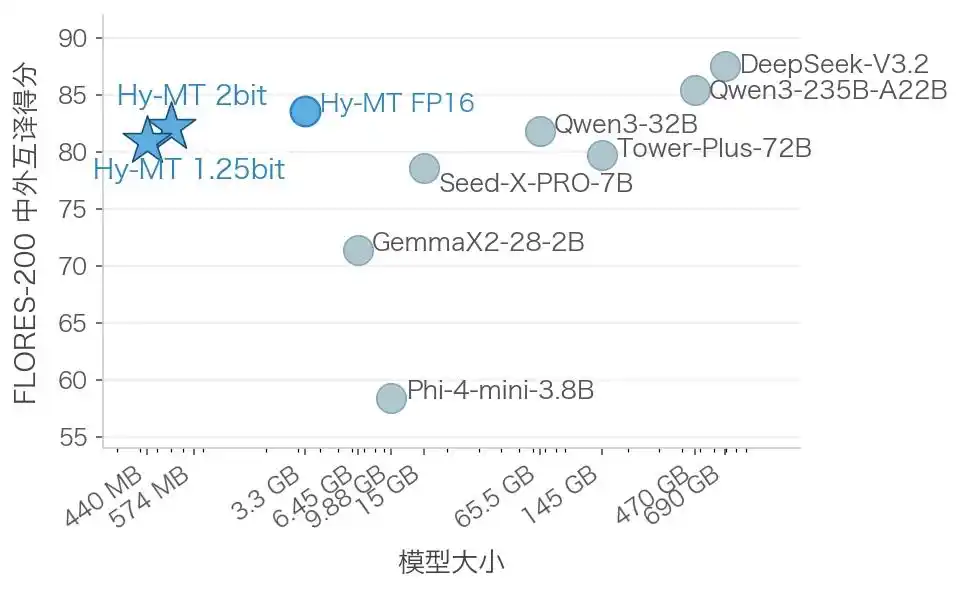

尽管体积被极致压缩,但其翻译质量并未大幅缩水,甚至在某些场景下超越了主流商用 API:

- 翻译质量:在多个基准测试(如 FLORES-200)中,该模型的翻译效果比肩甚至超越了谷歌翻译等主流商业系统,达到了千亿级(235B)大模型的 90 分位水平。

- 响应速度:在骁龙 888 等主流芯片上,处理 50 个 token 的平均耗时仅为 0.18秒,推理速度快于许多商用 API(通常在 0.4秒左右)。

- 广泛的语言支持:

- 原生支持 33 种国际语言(中、英、日、法、俄、阿拉伯语等)。

- 支持 5 种方言/少数民族语言(藏语、蒙古语、维吾尔语、壮语、彝语)。

- 总计支持 1056 个翻译方向。

Hy-MT1.5-1.8B-1.25bit技术规格对比

为了适应不同性能的设备,腾讯推出了两种量化方案,你可以根据手机配置选择:

表格

| 特性 | 1.25-bit 版本 (Sherry) | 2-bit 版本 (SEQ) |

|---|---|---|

| 模型体积 | 440 MB | 574 MB |

| 适用设备 | 全系机型(包括内存紧张的手机) | 中高端机型(追求更高精度) |

| 技术特点 | 稀疏高效三值量化,每4个参数仅用5bit存储 | 拉伸弹性量化,精度略高 |

| 核心优势 | 极致轻量化,常驻后台无压力 | 翻译质量几乎无损 |

Hy-MT1.5-1.8B-1.25bit如何获取与体验

目前该模型已全面开源,开发者和技术爱好者可以通过以下渠道获取:

- 开源平台:

- Hugging Face(面向海外用户)

- 魔搭社区 (ModelScope)(面向国内用户)

- Demo 体验:

腾讯提供了一个适配了“后台取词模式”的安卓 Demo 应用(APK),用户下载后可直接在手机上体验离线翻译功能。iOS 版本目前尚未上线,正在适配中。

Hy-MT1.5-1.8B-1.25bit的项目地址

- HuggingFace模型库:https://huggingface.co/AngelSlim/Hy-MT1.5-1.8B-1.25bit

- arXiv技术论文:https://arxiv.org/pdf/2512.24092

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...