Uni-1.1是由硅谷初创公司Luma AI正式推出的新一代企业级图像生成模型及API服务。

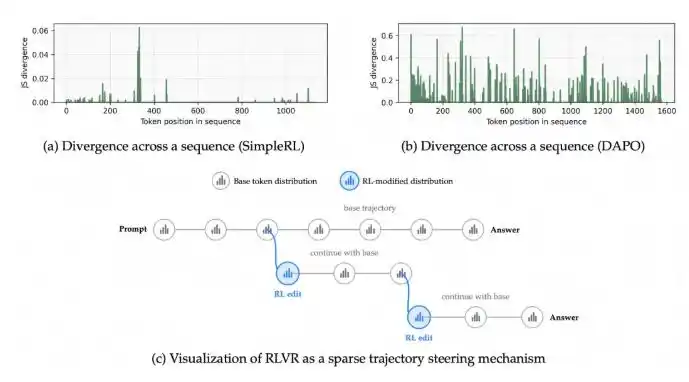

它最大的技术突破在于“换道超车”:抛弃了目前主流的扩散模型,转而采用类似大语言模型的自回归(Autoregressive)架构,实现了“推理”与“生成”的统一。这意味着它不再仅仅是“画图”,而是像人一样先“思考”构图和逻辑,再进行创作,解决了传统模型难以理解复杂指令和保持品牌一致性的痛点。

Uni-1.1核心突破

Uni-1.1 的核心在于它改变了 AI 生成图像的底层逻辑。

- 告别“抽卡”式生成:传统模型(如Midjourney)是基于噪声去噪,往往需要反复抽卡。Uni-1.1采用Decoder-only 自回归Transformer架构,文本和图像Token在同一序列中处理。

- 先思考,后画图:模型在生成像素前,会先进行结构化推理。它能理解复杂的物理规律、空间关系和逻辑约束。

- 例如: 输入“一个战国女子配剑”,它会先规划女子的姿态和剑的位置,而不是简单地把剑“贴”在图上,从而避免出现“多把剑”或“肢体扭曲”的逻辑错误。

- API 双端点设计:Luma 提供了 Reasoning(推理) 和 Generation(生成) 两个端点。开发者可以先让模型解构指令、规划构图,再执行渲染,将创意控制变成了可写入生产流程的契约。

Uni-1.1关键功能与能力

Uni-1.1 在企业级应用场景中表现出了极强的实用性:

- 多参考图硬约束(最多9张):

这是其杀手锏功能。你可以一次性输入最多 9张参考图(如品牌Logo、产品图、人物脸、材质样本),模型会将这些作为“硬约束”进行语义级融合。这完美解决了商业设计中角色变形、Logo 乱码的难题。 - 句子级图像编辑:

像编辑文档一样编辑图片。你可以说“把外套换成灯芯绒材质”,模型会精准修改指定区域,同时保留其他元素不变。 - 复杂版面与文字渲染:

支持生成包含报头、导航、正文的完整网页版面,且对中文、阿拉伯文等非拉丁字符的渲染质量极高,能直接生成可用的海报和贺卡。 - 空间与姿态控制:

支持旋转、视角切换等精确控制,甚至能根据一张正面草图生成背面视图,展现了极强的空间理解能力。

Uni-1.1性能与排名

在第三方权威榜单Arena.ai的盲测中,Uni-1.1表现惊人,直接跻身全球前三,仅次于OpenAI的 GPT-Image-2 和 Google 的 Nano Banana 2。

表格

| 维度 | 表现 |

|---|---|

| 综合排名 | 全球第 3 (ELO 1193),超越Microsoft AI、xAI等巨头模型。 |

| 空间推理 | 得分 0.58,超越 Google Nano Banana 2 (0.47)。 |

| 逻辑推理 | 得分 0.32,是 GPT-Image-1.5 的两倍以上。 |

| 物体检测 | 在 ODinW-13 测试中得分 46.2,几乎追平 Google Gemini 3 Pro。 |

Uni-1.1价格

Uni-1.1 采取了极具破坏力的定价策略,被称为“价格屠夫”:

- 极致性价比:2K 分辨率单图生成成本最低仅需 $0.0404 美元(约人民币 0.28 元),价格和延迟均不到同类顶尖模型的一半。

- 计费模式:提供 Build 计划(按量计费,适合灵活调用)和 Scale 计划(预留吞吐,适合大规模生产)。

- 商业案例:某广告活动原本预算 1500 万美元、周期一年,使用 Luma Agents 仅耗时 40小时、花费 不到2万美元 即完成了多国本地化素材制作。

Uni-1.1团队背景

令人惊讶的是,这个能挑战 OpenAI 和 Google 的模型,背后是一个不到 15 人的华人核心研究团队:

- 宋佳铭 (Jiaming Song):清华本科、斯坦福博士,DDIM(扩散模型加速奠基之作)作者。

- 沈博魁 (William Shen):斯坦福本博,CVPR 最佳论文得主。

Uni-1.1如何使用

目前 Uni-1.1 主要通过 API 面向开发者和企业开放:

- 注册与密钥:访问 Luma AI 开发者平台注册并获取 API Key。

- SDK 支持:官方提供 Python, JavaScript, TypeScript, Go 等多种语言的 SDK。

- 调用方式:通过 API 传入文本提示词和参考图,即可生成高质量图像。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...