“原生全模态大模型”是当前人工智能领域最前沿的技术方向之一。简单来说,它标志着AI从“拼凑感官”进化到了“拥有统一大脑”。

1. 什么是“原生全模态”?

要理解“原生全模态”,我们需要把它拆解为两个部分:

- 全模态: 指模型不仅能处理文本,还能同时处理图像、音频、视频等多种信息形式。

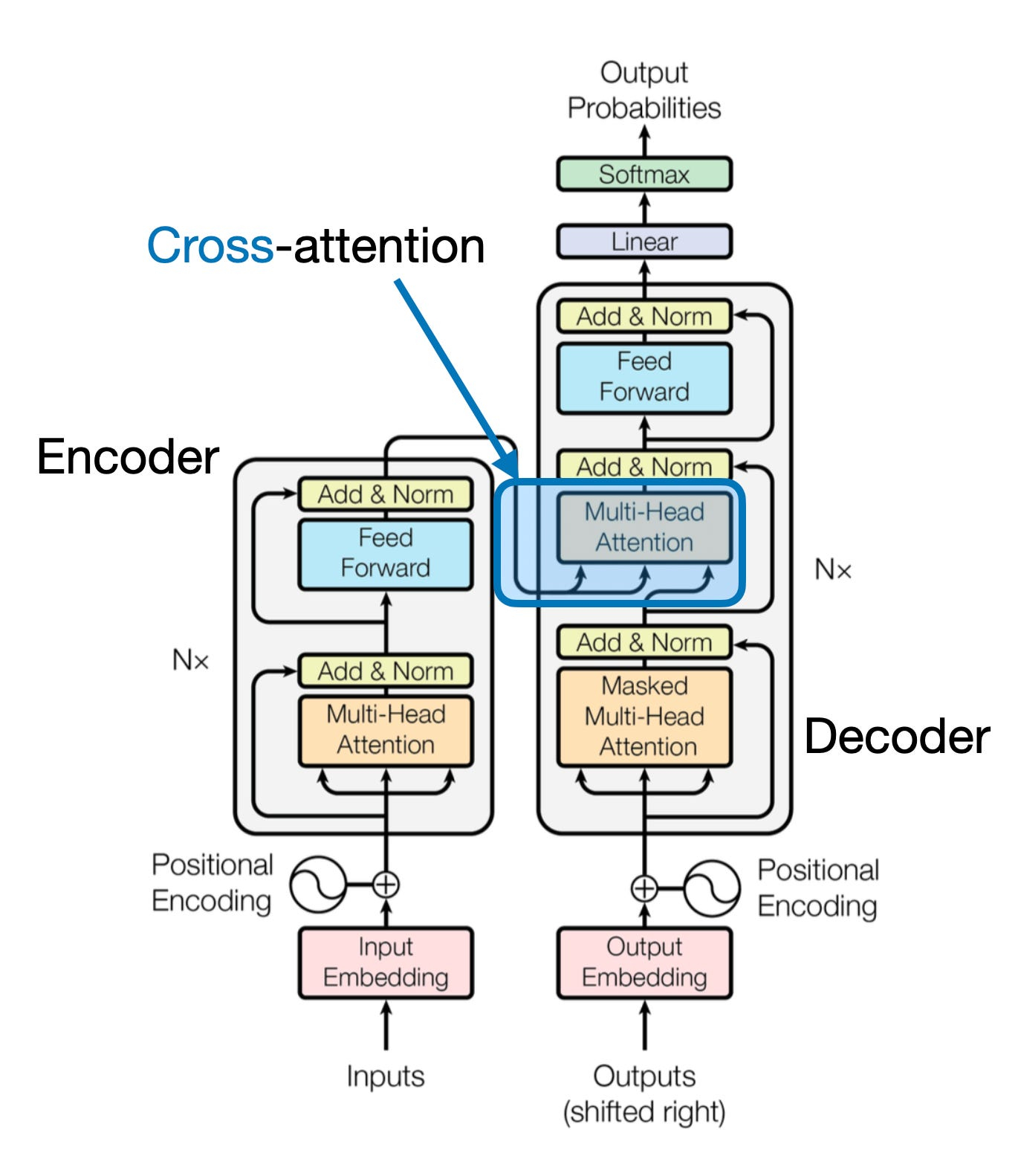

- 原生: 这是关键所在。它意味着模型从预训练阶段开始,就是在同一个统一的架构(Unified Architecture)下,同时学习文本、图像、声音等所有模态的数据。它不是后期“拼凑”出来的,而是“天生”就具备多模态理解能力。

打个比方:

- 传统多模态模型(拼接式): 就像一个“翻译团队”。有一个专门看图的专家,一个专门听音的专家,一个专门写字的专家。他们各自处理完信息后,再通过一个“协调员”把结果拼凑在一起。这种方式容易产生信息损耗和延迟。

- 原生全模态模型(统一式): 就像一个“全能天才”。他只用一个大脑,就能同时看、听、读、写。他在理解世界时,视觉、听觉和语言信号是在同一个神经网络中深度融合的,就像人类感知世界一样。

2. “原生全模态”与“传统多模态”的区别

表格

| 特性 | 传统多模态模型 | 原生全模态模型 |

|---|---|---|

| 架构设计 | 拼接式:视觉编码器 + 语言模型 + 投影层 | 统一式:单一神经网络(如Transformer)直接处理所有模态 |

| 训练方式 | 分阶段:先训练视觉,再训练语言,最后对齐 | 端到端:所有模态数据在同一阶段联合训练 |

| 信息处理 | 信息在不同模块间传递,存在损耗和延迟 | 信息在统一空间内融合,无损且高效 |

| 能力表现 | 擅长单一任务,跨模态推理较弱 | 擅长复杂推理,能理解“声音的情绪”或“视频的因果” |

3. 2026年的代表模型与厂商

根据最新的市场动态,国内外大厂都在争夺这一技术高地,以下是目前的代表性模型:

🇨🇳 国内第一梯队

- 通义千问 Qwen3.5-Omni(阿里巴巴):

- 发布时间: 2026年3月

- 特点: 采用 Thinker-Talker 双架构,能处理长达 10 小时的音频和 400 万帧视频。它不仅能“看懂”视频,还能“听着音乐写代码”(Vibe Coding),在音频和视频理解上表现极强。

- 文心大模型 5.0(百度):

- 发布时间: 2026年1月正式版

- 特点: 参数量达 2.4 万亿,采用统一的自回归架构。它在多模态理解上超越了Gemini-2.5-Pro,能够根据一段视频教程直接生成可运行的前端代码。

- MiMo-V2.5(小米):

- 发布时间: 2026年4月

- 特点: 刚刚开源的旗舰模型,拥有100万上下文窗口。它配备了专用的视觉和音频编码器,在视频内容分析和图表解读上性价比极高。

- HiDream-O1(智象未来):

- 发布时间: 2026年4月

- 特点: 提出了“世界模型”的概念,认为图像是世界建模的空间基底,致力于构建对真实物理世界的原生统一建模。

🌍 国际巨头

- Nemotron 3 Nano Omni(英伟达):

- 发布时间: 2026年4月

- 特点: 强调“原生全模态理解+高效推理”,专为AI智能体(Agent)设计,能同时处理文本、图像、音频甚至视频输入,帮助AI智能体效率提升 9 倍。

4. 为什么“原生全模态”是AI的必经之路?

原生全模态不仅仅是技术的升级,更是AI落地场景的质变:

- 更真实的交互: 人类的交流是伴随着表情、语气和手势的。原生全模态模型能听懂你的“弦外之音”(语气中的犹豫)或看懂你的“言外之意”(图片中的细节),让交互更像人与人。

- 更强的逻辑推理: 在处理复杂任务(如“看完这个2小时的物理讲座视频,总结出公式并写一个演示程序”)时,统一架构能更好地捕捉跨模态的逻辑关联。

- 智能体(Agent)的基石: 未来的AI智能体需要像人一样在数字世界或物理世界中行动,必须具备“眼观六路、耳听八方”的能力,原生全模态正是实现这一目标的基础设施。

概括: 原生全模态大模型是AI从“工具”迈向“伙伴”的关键一步。它不再是把不同感官割裂开来,而是试图用一个统一的大脑去完整地理解这个丰富多彩的世界。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...