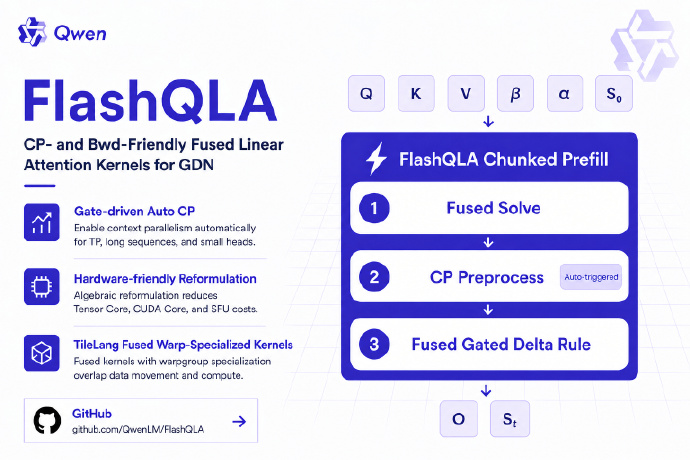

FlashQLA是通义千问团队(Qwen Team)正式开源的一个高性能线性注意力算子库。简单来说,它是专门为提升大语言模型(特别是Qwen3.5、Qwen3.6及后续系列)在处理超长文本时的训练和推理速度而设计的底层加速工具。

FlashQLA快在哪里?

FlashQLA在NVIDIA Hopper架构(如 H100/H200)的GPU上表现极其出色。与之前的主流算子(FLA triton Kernel)相比,它的性能提升非常显著:

- 前向传播(推理/生成): 速度提升 2-3 倍。

- 反向传播(训练): 速度提升 2 倍。

这意味着,对于需要处理海量数据的模型预训练,或者对延迟敏感的端侧智能体(Agentic)应用,FlashQLA能大幅降低成本并提升响应速度。

FlashQLA为什么它能这么快?

FlashQLA并非简单的代码封装,而是从算法和硬件层面进行了深度优化:

- 门控驱动的自动化卡内序列并行 (Gate-driven Auto Intra-Sequence Parallelism)

- 原理:它利用了 Qwen 模型中 GDN(门控三角网络)特有的“指数衰减”性质。

- 作用:系统能自动识别场景(如长序列、小头数等),智能开启并行计算,极大提高了 GPU 核心(SM)的利用率,避免了资源浪费。

- 硬件友好的代数改写

- 原理:团队对计算流程进行了数学层面的“整容”,在不损失数值精度的前提下,减少了复杂的计算步骤。

- 作用:有效降低了 Tensor Core、CUDA Core 和特殊函数单元(SFU)的负载,让算子在硬件上跑得更轻快。

- 基于 TileLang 的算子融合

- 原理:使用TileLang语言编写了高度融合的算子,并采用了手动Warp特化技术。

- 作用:让数据搬运和计算任务重叠进行,进一步压榨了硬件性能。

FlashQLA的应用场景

- 大模型训练:加速Qwen3-Next、Qwen3.5、Qwen3.6等系列的训练过程。

- 长文本推理:让模型在处理几十万字甚至更长的上下文时,速度更快,显存占用更优。

- 端侧应用:帮助手机、PC 等终端设备更流畅地运行复杂的 AI 智能体任务。

FlashQLA的项目地址

- 项目官网:https://qwen.ai/blog?id=flashqla

- GitHub仓库:https://github.com/QwenLM/FlashQLA

最后想说,FlashQLA是通义千问团队为了让大模型“跑得更快、更省资源”而打造的一把底层利器,目前已在GitHub等平台开源,供开发者使用。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...