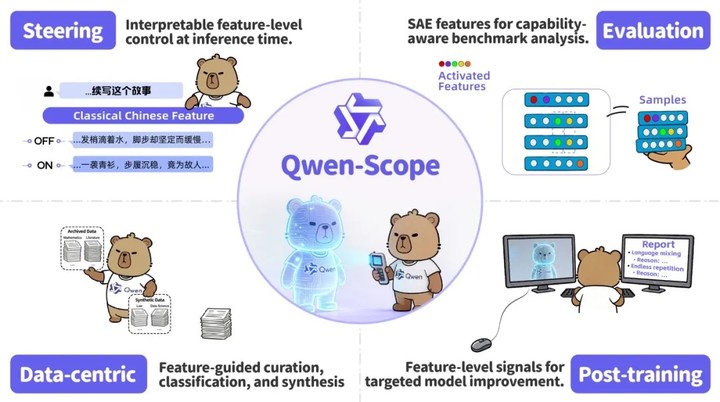

Qwen-Scope是阿里千问正式开源的一款大模型可解释性分析模块。简单来说,它就像是给黑盒般的大模型装上了一个“透视镜”或“仪表盘”,让我们能够看穿模型内部的运作机制,理解它为什么会产生某种回答,甚至能直接干预和修正它的行为。

Qwen-Scope核心技术

Qwen-Scope基于Qwen3及Qwen3.5系列模型训练而成。它的核心技术原理是在模型的隐藏层中嵌入稀疏自编码器(SAE)。

- 工作原理:通过施加稀疏性约束,SAE能自动从模型复杂的参数中提取出高度解耦、低冗余且语义明确的特征。

- 训练规模:使用了0.5B(5亿)词元的数据进行训练,覆盖了7个大模型(包括稠密模型和混合专家模型),共发布了 14 组SAE权重。

Qwen-Scope四大核心应用场景

Qwen-Scope不仅仅是用来“看”的,更是用来“改”的。它将复杂的参数运算转化为人类可理解的概念,主要应用于以下四个环节:

Qwen-Scope的项目地址

- HuggingFace模型库:https://huggingface.co/collections/Qwen/qwen-scope

- 技术论文:https://qianwen-res.oss-accelerate.aliyuncs.com/qwen-scope/Qwen_Scope.pdf

Qwen-Scope的同类竞品对比

| 对比维度 | Qwen-Scope | Gemma Scope |

|---|---|---|

| 发布方 | 阿里巴巴 / 通义千问 | Google DeepMind |

| 覆盖模型 | Qwen3 / Qwen3.5 系列(7 个模型) | Gemma 2 / 3 系列 |

| 架构支持 | 稠密模型 + MoE | 稠密模型 |

| SAE 架构 | Top-k SAE | JumpReLU SAE |

| 开源规模 | 14 组 SAE 权重 | 400+ SAEs,3000 万+特征 |

| 核心应用 | 推理控制、评测分析、数据合成、训练优化 | 机制解释、安全分析、电路追踪 |

| 数据合成 | 特征驱动合成,数据能效比提升约 15 倍 | 主要依赖传统合成方案 |

| 评测分析 | 支持 benchmark 冗余与覆盖度分析 | 侧重特征可视化与交互探索 |

| 中文支持 | 原生支持,含古典中文等特色风格特征 | 主要面向英文场景 |

| 交互平台 | Hugging Face / 魔搭社区 | Neuronpedia |

Qwen-Scope的推出标志着大模型的可解释性研究从理论走向了实用,它不仅能帮助我们“看懂”模型,更能作为驱动模型进化的核心引擎。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...