Qwen3.6-35B-A3B是阿里巴巴通义千问团队于2026年4月16日正式开源的一款高性能混合专家(MoE)模型。

作为Qwen3.6系列的首个开源权重版本,它凭借“350 亿总参数、仅30亿激活参数”的极致能效比,在智能体编程和多模态推理领域树立了新的开源标杆,性能表现足以媲美甚至超越参数量大得多的稠密模型(如 Qwen3.5-27B)。

核心架构:极致的“以小博大”

Qwen3.6-35B-A3B采用了先进的稀疏混合专家(MoE)架构,实现了性能与效率的完美平衡:

- 参数规模:总参数量高达350亿,但在推理时仅激活约 30 亿参数。

- 架构设计:采用Gated DeltaNet + Gated Attention 的混合注意力机制。每10层中包含3层线性注意力(DeltaNet)和 1 层标准注意力,配合MoE前馈网络(256个专家,每次激活8+1个)。

- 效率优势:这种设计大幅降低了显存占用和推理成本,使其在保持顶尖智能的同时,能够以更低的算力门槛进行部署。

两大杀手级能力

1. 智能体编程(Agentic Coding)的“小钢炮”

该模型在代码生成、调试及复杂工作流处理上表现卓越,多项基准测试成绩超越前代及同级稠密模型:

- SWE-bench Verified:得分 73.4,逼近Qwen3.5-27B(75.0),远超Gemma4-31B(52.0)。

- Terminal-Bench 2.0:得分 51.5,在同规模模型中登顶,展现了强大的终端操作与长程任务规划能力。

- 前端开发:在QwenWebBench中获得1397的Elo评分,具备断层领先的代码生成质量。

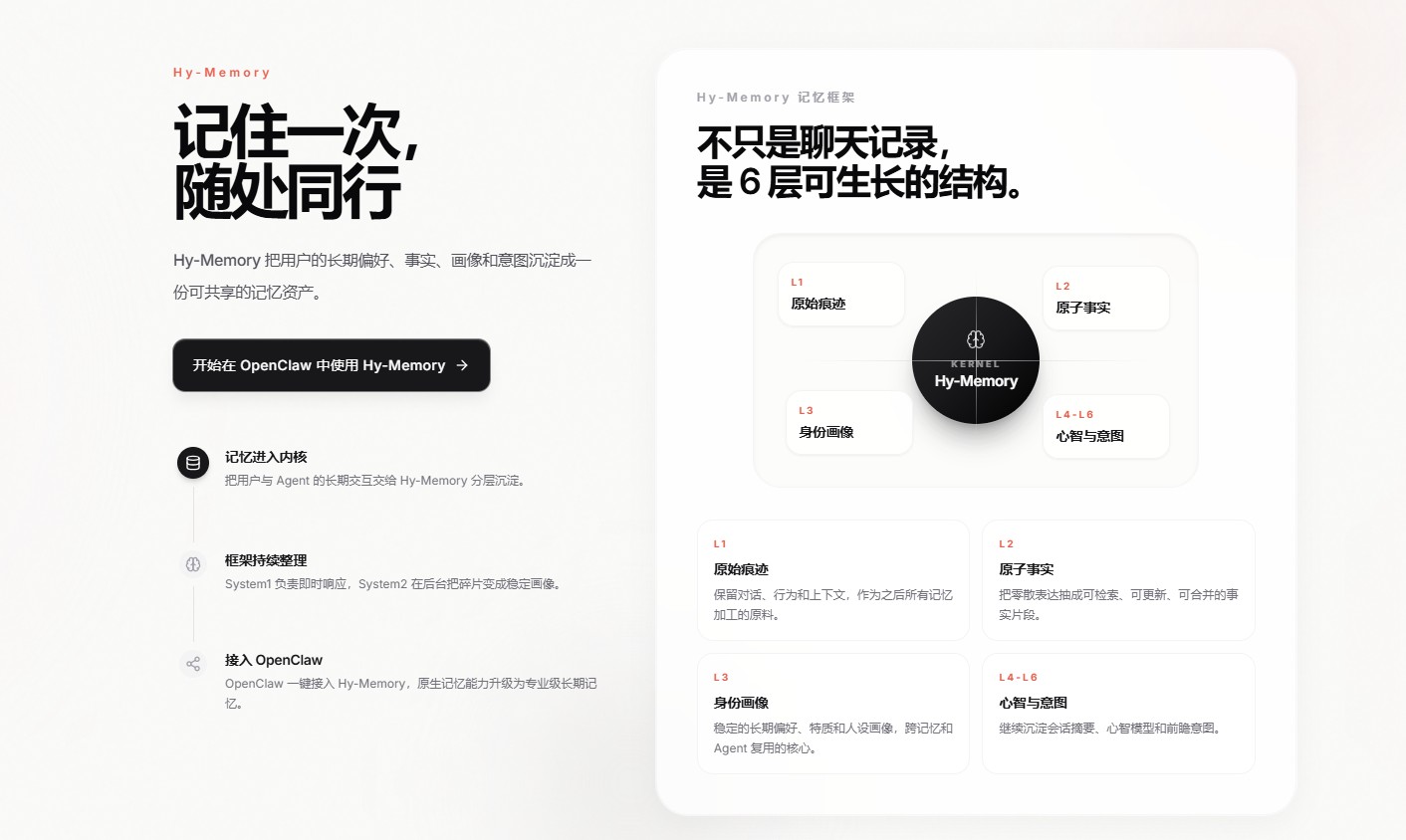

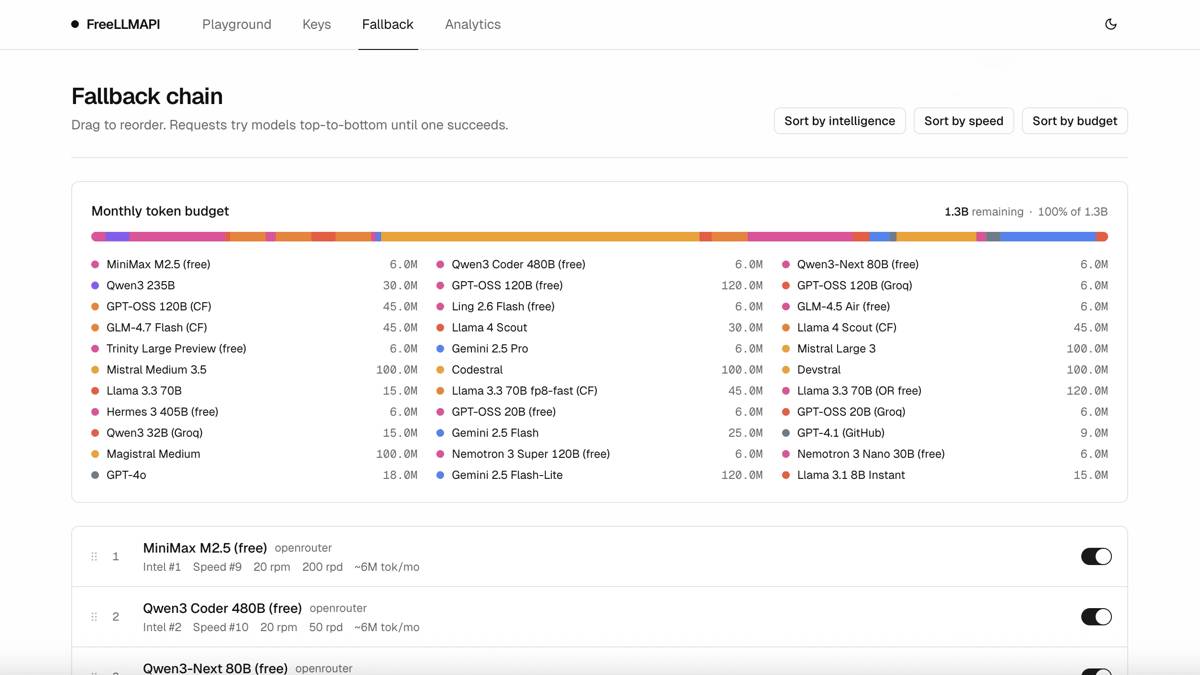

- 生态兼容:无缝集成OpenClaw、Claude Code、Qwen Code等主流AI编程助手,可直接作为终端智能体使用。

2. 原生多模态与空间智能

作为原生视觉语言模型,它不仅能“看懂”图片,还能进行深度的空间推理:

- 视觉理解:在MMMU、MathVista等权威基准上,表现已持平甚至超越Claude Sonnet 4.5。

- 空间智能:RefCOCO得分高达92.0,ODInW13得分50.8,在物体定位与空间关系理解上处于行业领先地位。

- 长视频/长文本:原生支持262,144 Tokens上下文(可扩展至约 100 万),能够处理整本技术文档或长视频内容。

独特功能:思维保留 (Preserve Thinking)

为了适应复杂的智能体任务,Qwen3.6-35B-A3B引入了思维保留机制:

- 双模式支持:支持“思考模式”(展示完整思维链,适合复杂推理)和“非思考模式”(快速响应,适合日常问答)。

- 上下文复用:通过

preserve_thinking参数,模型可以在多轮对话中保留并复用历史的推理轨迹。这意味着在进行多步代码调试或长周期任务时,模型不会“忘记”之前的思考路径,显著减少了重复推理的开销,提升了任务连贯性。

性能对比一览

表格

| 评测基准 | Qwen3.6-35B-A3B | Qwen3.5-27B (稠密) | Qwen3.5-35B-A3B (前代) |

|---|---|---|---|

| SWE-bench Verified | 73.4 | 75.0 | 70.0 |

| Terminal-Bench 2.0 | 51.5 | 41.6 | 40.5 |

| QwenWebBench (Elo) | 1397 | 1068 | 978 |

| NL2Repo | 29.4 | 27.3 | 20.5 |

| RefCOCO (空间智能) | 92.0 | – | – |

获取与部署方式

- 模型权重下载:

- Hugging Face:

Qwen/Qwen3.6-35B-A3B - ModelScope:

Qwen/Qwen3.6-35B-A3B

- Hugging Face:

- 在线体验:

- 直接在 Qwen Studio 官网进行对话体验。

- API 调用:

- 通过阿里云百炼平台,以

qwen3.6-flash的名称调用 API,兼容OpenAI和Anthropic接口格式。

- 通过阿里云百炼平台,以

- 本地部署:

- 支持vLLM、SGLang、Transformers等主流推理框架。

- 个人用户可使用 Unsloth GGUF 量化版本在消费级显卡上运行。

Qwen3.6-35B-A3B的发布证明了稀疏MoE架构的巨大潜力——通过更聪明的架构设计,小参数量的激活也能爆发大模型的能量,为开发者和企业提供了极具性价比的智能化解决方案。

Qwen3.6-35B-A3B的项目地址

- HuggingFace模型库:https://huggingface.co/Qwen/Qwen3.6-35B-A3B

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...