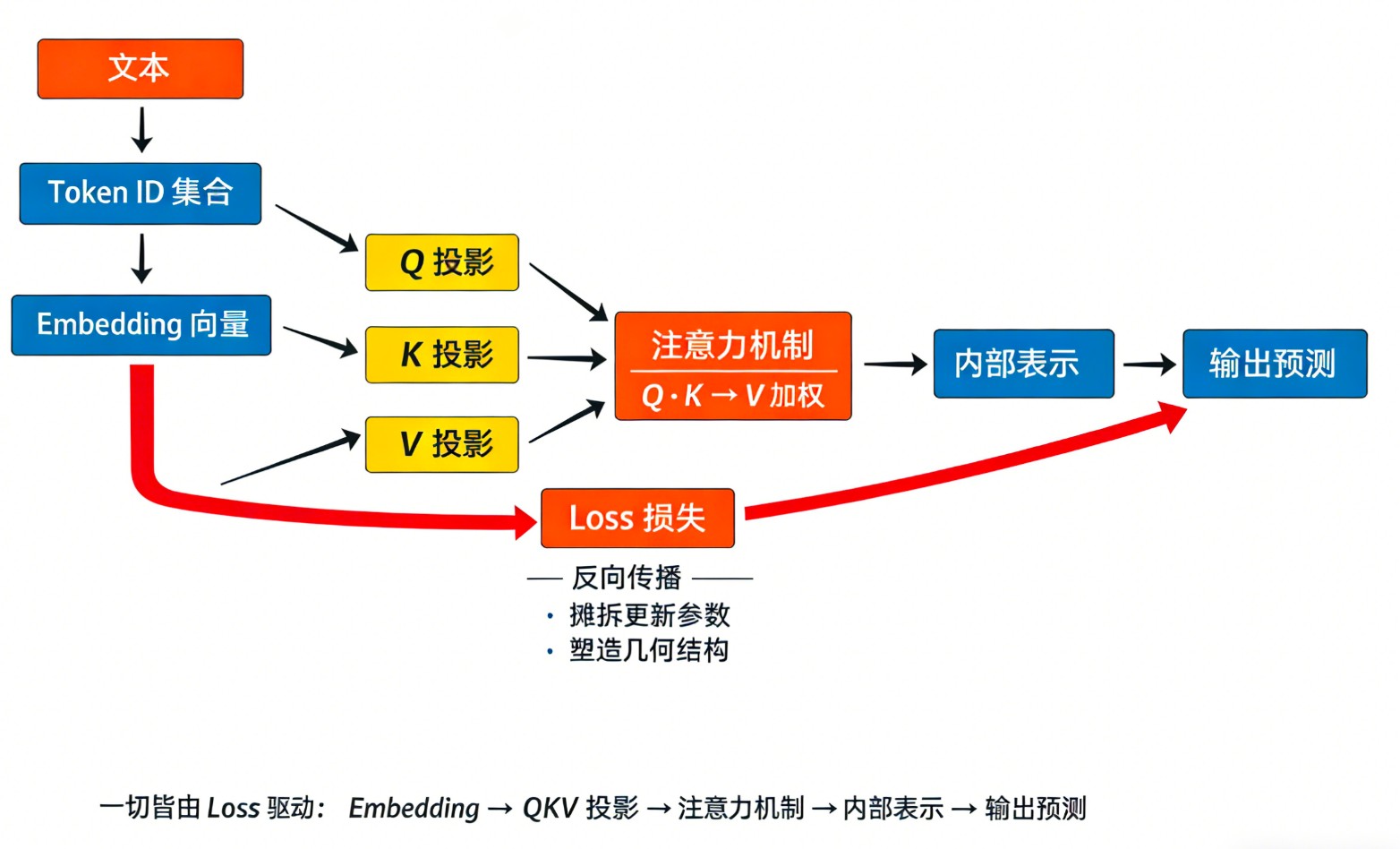

标准注意力机制,通常指缩放点积注意力(Scaled Dot-Product Attention),是现代大模型(如Transformer、GPT系列)的基石。

它的核心思想非常直观:模拟人类“聚焦重点”的能力。在处理信息时,模型不再是“平均用力”地看待所有输入,而是根据当前的需求(Query),动态地去检索(Key)并提取(Value)最相关的信息。

核心概念:Q、K、V 是什么?

理解注意力机制,最关键的是理解三个向量:Query(查询)、Key(键)、Value(值)。

我们可以用一个“图书馆找书”的通俗类比来解释:

表格

| 符号 | 名称 | 角色 | 通俗类比(图书馆场景) |

|---|---|---|---|

| Q | Query | 发起者 | 你手里的“搜索条”。比如你想找关于“人工智能”的书,这个搜索词就是Q。 |

| K | Key | 被检索者 | 书架上每本书的“索引标签”。每本书都有标签(如“历史”、“AI”、“烹饪”),这些就是K。 |

| V | Value | 实际内容 | 书里的“具体内容”。当标签匹配成功后,你真正阅读和吸收的知识就是V。 |

工作流程是: 拿着你的搜索条(Q),去和书架上所有书的标签(K)做对比,算出相似度。相似度高的书,你就去读它的内容(V),最后把所有读到的内容加权整合起来。

计算流程:五步走

标准注意力机制的计算过程可以拆解为以下五个步骤,这也是Transformer模型中每一层都在做的事情:

- 线性变换(生成Q、K、V)

输入向量(比如一个词“猫”)会分别乘以三个可学习的权重矩阵( WQ,WK,WV ),从而生成对应的查询向量Q 、键向量K和值向量V 。 - 计算相似度(点积 QKT )

计算 Q 和所有 K 的点积。- 目的:衡量相关性。如果Q和某个K的方向一致(点积大),说明它们高度相关(比如“猫”和“动物”相关)。

- 缩放(除以 dk )

将点积的结果除以 dk ( dk 是向量的维度)。- 目的:防止数值过大。当维度很高时,点积结果会变得非常大,导致后续的Softmax函数进入梯度极小的区域(梯度消失),阻碍模型训练。

- 归一化(Softmax)

对缩放后的分数进行Softmax操作。- 目的:将分数转化为概率分布(0到1之间,且和为1)。分数越高的位置,权重越大,意味着模型应该“更关注”那个位置的信息。

- 加权求和(乘以 V )

用Softmax得到的权重,对值向量V进行加权求和。- 结果:权重高的V被保留更多,权重低的被忽略。最终得到的向量就是融合了上下文信息的“注意力输出”。

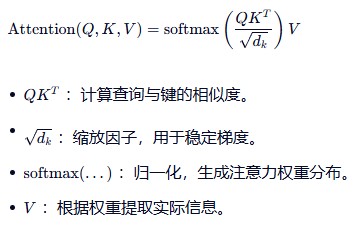

数学公式

标准注意力机制可以用一个简洁的公式概括:

关键机制:掩码(Masking)

在实际应用中,我们往往不能“看到”所有信息。这时就需要引入掩码(Mask)机制,在Softmax之前给不需要关注的位置加上一个极大的负数(如 −1e9−1e9 ),使得这些位置的权重在Softmax后趋近于0.

主要有两种掩码:

- 因果掩码(Causal Mask):

- 场景:语言模型生成(如GPT)。

- 作用:防止“作弊”。在预测第 t 个词时,模型只能看到 t 之前的词,不能看到未来的词。掩码会遮住所有“未来”的位置,强制信息流只能从过去流向未来。

- 填充掩码(Padding Mask):

- 场景:批量处理不同长度的句子。

- 作用:忽略无效信息。为了并行计算,短句会被填充(PAD)到和长句一样长。填充的部分没有意义,掩码会告诉模型“不要关注这些填充符号”。

为什么它如此重要?

标准注意力机制的出现解决了传统循环神经网络(RNN)的两个致命弱点:

- 长距离依赖问题:RNN处理长句子时容易“遗忘”开头的内容。而注意力机制允许模型在计算任意位置时,直接“看到”序列中的所有其他位置,无论距离多远。

- 并行计算能力:RNN必须一个字一个字按顺序算。而标准注意力机制可以通过矩阵运算,一次性计算所有位置的注意力,极大地提升了训练速度。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...